-

运动目标检测是计算机视频图像处理中最基础最关键的技术,在智能视频监控、机器人导航、医学图像分析中有着重要的作用.视频中运动目标的自动检测更是成为智能视频监控的重点和热点,其目的在于通过对目标实施检测和分割实现目标的定位和跟踪.

目前常见的运动目标检测算法有帧间差分法、光流法、背景差分法[1-2].帧间差分法用连续图像相减来实现时域差分,但一般不能完整提取出运动目标的全部特征,因此一般适用于精度不高的场合.光流法计算量大,因此实时性低.背景差分法是运动检测最常用的方法之一,对特征检测比较全面,但是对光照等动态变化比较敏感.

由于数字视频多为彩色视频,因此视频图像的颜色信息可以作为目标提取的一个重要特征.不同颜色空间反映的图像信息不同,导致颜色空间的选择成为影响前景探测性能的重要因素[3].经典的颜色空间包括RGB,HSV(Hue Saturation Value),LAB(L表示亮度,A表示从洋红色至绿色的范围,B表示从黄色至蓝色的范围),YCbCr(Y为颜色的亮度,Cb和Cr分别为蓝色和红色的浓度偏移量)和YUV(Y表示明亮度,U和V分别是色度和浓度)等[4].

杨会锋等[5]提出了一种改进的基于边缘特征和K均值聚类相结合的运动目标检测算法.实验表明,该方法能够有效解决噪声的影响,但是对于光照十分敏感.德国学者Lissner等[6]从人类神经对色彩感知的角度出发,构建了避免亮度、色调和色度等交叉干扰的颜色空间模型.实验结果表明,该模型在图像分割领域有较好的性能,在视频的前景检测应用中并不理想.赵红雨等[7]提出了一种基于HSV颜色空间的运动目标检测方法.利用HSV颜色空间各分量相互独立性及H分量对光照不敏感的特性,用自适应阈值法实现了运动目标的分割. IF1F2是一种新兴的对RGB进行傅里叶变换之后得到的颜色空间[8],其专用于生物显微图像领域,因此具有很大的局限性.黎洪松等[9]采用基于自组织映射的运动模式识别方法,将自组织映射应用到视频中来.文献[10]通过自组织映射的前景探测结合SVM(Support Vector Machine)算法实现了较理想的人体目标检测与跟踪,但这一方法缺乏能带来稳定性能的颜色空间模型.文献[11]提出一种自组织映射背景分离算法,能够在较短时间内实现视频图像前景和背景的分离,但其不适用于长时间的视频观测.实验证明,自组织映射对视频背景分离有较好的效果.

全文HTML

-

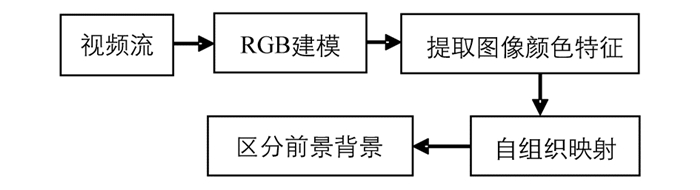

基于颜色空间的运动目标检测算法基本流程如图 1所示.

本文用文献[10]提到的自组织映射模型结合颜色空间来实现视频中的运动目标检测.

自组织映射模型用已知的背景场景模型进行训练,用其像素作为训练样本,从而判断哪些像素属于前景.设在视频图像中某像素在位置x处的颜色值为v,则有如下公式.

其中ɑ,β,θ分别代表背景图像、运动物体和约束参数.公式(1)表示v和x的概率关系,公式(2)定义约束参数.

该模型借助概率混合来表示每个像素的特性,因而可以实现任意颜色前景目标的构建.其构建前景一致分布模型的方法如公式(3)所示.

其中C是总颜色空间,g(C)是C的三维卷积.某个像素点处的背景色取值与场景的特征有关.由于每个神经元可以专注于一组输入数据集,且场景特征决定像素点的取值,因此概率自组织映射可以处理图像中任一像素点的背景色分布.

在自组织映射模型中,神经元个数由公式(4)中的N表示.

本文默认神经元分布于一个矩形空间,则任意2个神经元S,T的拓扑距离可用其欧氏距离表示,如公式(5)所示.

其中d(S,T)表示神经元S,T的拓扑距离. pS和pT分别为S,T在矩形空间中的位置.

为了降低算法的计算开销,可以将映射中的每个神经元视为一个球形高斯概率密度分布,如式(6)所示.

其中,σ2为像素点的方差,σ1和σ2分别为σ的上下边界.公式(7)的约束能够使该自组织映射模型更真实地表达输入像素的分布.

本文采用贝叶斯分类法来判断某一对象是否属于背景,如公式(8)所示.

其中,Pα,x(v)表示输入对象v属于背景的概率,则对象v属于前景的概率可以用公式(9)表示为

在实际生活中,运动目标的检测识别总是受到摄像机失真、目标与背景同色等问题的干扰,因此本文选择目标像素A的8邻域像素来平滑噪声带来的干扰.其前景噪声消减可由式(10)实现.

其中z(A)包含A和它的8邻域像素,ρA,B表示像素A,B的相关系数.

在众多颜色空间中,RGB是最常见的一种,大多数视频采集设备都用RGB颜色空间的8bit数值来表示采集到的数据.为了避免不同颜色空间之间的转换,本文直接采用RGB颜色空间并结合自组织映射来进行数字视频中的运动目标检测.

记颜色空间C中某颜色为v=(v1,v2,v3),由公式(5)可知,颜色v和u差距可表示为

由于在不同场景中,不同颜色分量所包含的信息量并不均等,因此在RGB颜色空间中,给予不同颜色分量不同的权重能够更有效地表达该场景的颜色分布.本文通过公式(12)来重新定义RGB颜色空间中颜色v的表示方法.

其中,非负系数a,b,c分别表示不同颜色分量的权重,公式(13)为权重系数a,b,c的归一化约束.

在球形高斯数据拟合中,只有当各维度的比例相同时才可应用式(6)进行建模和参数学习.本文引入颜色空间转换参数λ,并通过方程(14)将颜色空间C转换为C’.

其中,g(C)=2553.

对于一个给定的背景模型,其对称模型的均值和方差也可通过公式(15)得到

则转换之后模型的混合概率如公式(16)所示.

结合公式(1)、公式(14),得到公式(17)

由公式(17)可知,像素分类概率并不受变参数λ的影响.

通过本节提出的不均等权重的RGB颜色空间模型,可以改进自组织映射前景检测算法.并且该自组织映射模型的原理可以移植至任何新的颜色空间中去.本文提出的改进的颜色空间通过对不同颜色分量赋予不同的权重,从而实现更真实地表示视频对象颜色和色差的目的,进而提高运动目标的检测准确率.

-

本文在普通PC的硬件环境及Matlab 7.0和Eclipse 3.3的软件环境下,采用视频监控设备在室内、室外各种不同背景下所采集的视频数据流,以及i-Lids bag and vehicle detection challenge(i-LBVDC)[12],Audiovisual people dataset (APD)等视频处理的经典数据集作为实验样本进行实验.

根据公式(11),实验对a,b,c进行了不同的取值,从而对比不同权重下该颜色空间的性能(表 1).

在实验中,取测试阶段得到最高准确率的值作为后续实验中该颜色空间各颜色分量的权值.

-

本节通过与不同算法对比,考察本文所提出的改进算法的整体有效性.

本部分的对比算法为BVBS算法和AT-SOM模型以及文献[13]中的KNN-SVM算法.实验结果如表 2所示.

由表 2可知,本文提出的改进算法在各对比算法中具有最高的检测准确率.通过表 1和表 3的对比可以看出,在提高前景检测性能方面,组分加权的颜色空间以及与自组织映射结合的检测策略均能提高视频检测效果.

-

为了更加全面地考察本文算法的性能,本节将自组织映射模型结合多种颜色空间作为对比,对比颜色空间包括最常见的RGB,HSV和YCbCr.实验数据集为前面所提到的室内和室外自采数据、i-LBVDC以及APD.实验结果如表 3所示.

为了对性能对比得到更综合的结论,实验部分还对比了各种颜色空间下运动目标检测中的F值,如表 4所示.

表 3和表 4表明,本文提出的结合自组织映射和RGB颜色空间的算法,其实验结果明显优于RGB,HSV空间;对于YCbCr模型也具有一定的优势.

同时,本文提出的改进RGB颜色空间较之实验中的对比项具有更强的稳定性.

2.1. 不同算法下的前景检测准确率对比

2.2. 不同颜色空间下运动目标检测性能

-

随着数字视频在各个领域的广泛普及和应用,运动目标识别作为视频处理的关键技术,其重要性越来越得到彰显.现有的颜色空间在视频色彩还原上或多或少会存在一定的失真,因此如何更加保真地还原数字视频真实的色彩也成为目前急需解决的难题.本文在经典RGB空间的基础上对各颜色分量赋予不同的权重,并结合自组织映射形成新的视频运动目标检测算法.实验结果表明,本文提出的改进颜色空间对提高运动目标检测性能有明显的辅助作用,并且具有可靠的检测准确率.

由于视频的环境复杂多变,例如夜间环境光线昏暗,或者拍照角度等问题使得在很多情况下,前景和背景区分十分艰难.因此,后期需要提取运动目标更多、更有效的特征来实现更精准的运动目标检测.

下载:

下载: