-

开放科学(资源服务)标识码(OSID):

-

情绪识别作为情感计算的核心任务,在人机交互、心理健康监测以及智能驾驶等领域具有重要的应用价值[1-2]。与面部表情、语音等易受主观意图掩饰的外部信号不同,脑电信号(Electroencephalogram,EEG)能够直接反映大脑皮层的神经生理活动,被认为是识别情绪状态的客观生理指标[3]。然而,EEG自身具有明显的非平稳性,同时信噪比较低,导致即使针对同一被试,其脑电模式也会随时间推移、疲劳程度及心理状态的变化而发生动态漂移[4-5]。因此,如何在信号内部高度动态变化的情况下构建高精度、鲁棒的个性化情绪识别模型,仍然是当前面临的重大挑战。

针对EEG信号的复杂特性,早期研究更多依赖手工提取时频域特征,并结合传统机器学习算法进行分类。近年来,深度学习凭借其强大的特征提取能力逐渐占据主导地位。研究者广泛采用卷积神经网络(Convolutional Neural Network,CNN)和长短时记忆网络(Long Short-Term Memory,LSTM)来捕捉EEG的时空特征。例如,Le等[6]提出了一种结合通道注意力机制与LSTM的轻量化模型,在单通道和多通道设置下均取得了较优的性能。Khan等[7]设计了DAFNet双路径网络,通过并行提取局部DE特征和全局相干性特征来增强表征能力。尽管这些方法在时空特征挖掘上表现出一定潜力,但往往忽视了大脑区域间复杂的非欧几里得空间依赖关系。

因此,为更好地建模脑区的非欧几里得空间依赖关系,图神经网络(Graph Neural Network,GNN)及其变体成为近年来的研究热点。Zhang等[8]引入格兰杰因果分析构建脑网络连接,其性能优于传统基于物理距离的静态图卷积方法。为应对个体差异,Wang等[9]提出的MG-DA模型结合图卷积与领域自适应,提取多频段拓扑特征。Liu等[10]设计的DCENet则通过协同进化机制探索时空融合关系。然而,随着研究的深入,现有方法在多域特征的深度交互与个体脑网络微观动态的精细刻画方面仍暴露出明显不足。特别是在针对单一被试的分析中,如何从有限的数据中挖掘出更具判别力的多维拓扑模式,仍有待进一步探索。

尽管上述方法取得了显著进展,但现有的EEG情绪识别研究仍存在3个核心局限性:第一,跨域特征交互的深度不足。多数模型虽然使用了时域和频域特征,但往往在独立处理后只进行简单的拼接或加权。这种浅层融合缺乏对不同特征域之间互补语义的显式建模,导致微分熵(Differential Entropy,DE)与功率谱密度(Power Spectral Density,PSD)之间的内在对应关系未被充分利用,限制了模型在处理非平稳信号时的抗噪能力与协同增益[11]。第二,动态拓扑建模存在单一性与片面性。大脑的情绪活动涉及幅值耦合与相位同步等多维机制。然而,现有动态GNN多依赖单一指标构建邻接矩阵[12],或仅简单地将多指标进行平均处理。这种做法难以同时捕捉脑区间的协同关系,容易导致关键拓扑信息的稀释或丢失[13]。第三,时序依赖与图动态演化的协同建模仍不充分。EEG的情绪模式在相邻时间片段间存在动态变化。虽然Transformer等结构增强了时序依赖建模能力,但在被试内实验通常面临的小样本、高噪声场景下,复杂的自注意力机制容易出现过拟合或泛化性能不稳定[14]。如何在捕捉图结构动态演变的同时,利用更鲁棒的机制对相邻时间片段间的时序关联进行双向建模,仍是一个有待解决的问题。

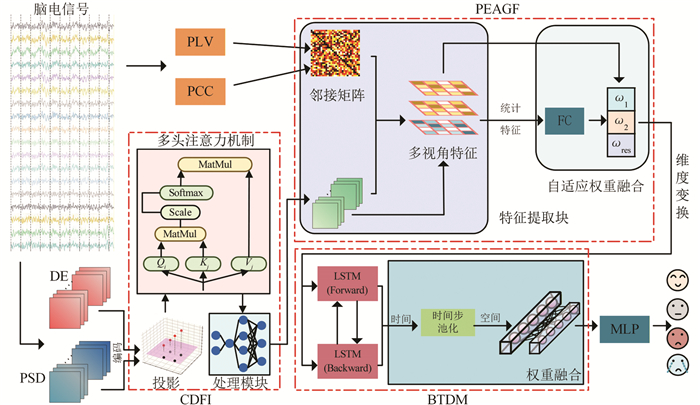

为弥补上述不足,本研究提出了一种基于跨域特征交互与感知增强图长短时记忆网络(Cross-Domain Perception-Enhanced Graph Bi-LSTM,CD-PEBL)的情绪识别模型。首先,针对跨域融合问题,设计了跨域特征交互模块(Cross-Domain Feature Interaction Module,CDFI),摒弃简单的拼接操作,利用双向交叉注意力机制在统一空间中建立DE与PSD的互补关联,实现语义的定向注入与增强。其次,针对拓扑建模单一性问题,构建了感知增强自适应图融合模块(Perception-Enhanced Adaptive Graph Fusion Module,PEAGF),从幅值与相位2个角度构建双视角先验,并通过门控机制自适应融合多尺度图表征,从而更细粒度地刻画情绪诱发下的脑网络动态演变。最后,引入时序依赖建模模块(Bi-directional Temporal Dependency Modeling Module,BTDM)对融合后的时空序列进行建模,在保证鲁棒性的前提下捕捉相邻时间片段间的双向时序关联。

本研究的主要贡献如下:第一,设计了跨域特征交互模块。引入交叉注意力机制实现时频表征之间的双向对齐与互补增强,并结合多维校准机制抑制噪声扰动,从而缓解传统多域特征融合中存在的语义割裂问题;第二,构建了感知增强自适应图融合模块。以皮尔逊相关系数(Pearson Correlation Coefficient,PCC)与相位锁定值(Phase Locking Value,PLV)作为双重生理先验构建多视图功能连接关系,并在可学习动态图框架下提取不同拓扑视角下的互补结构特征,随后通过统计感知驱动的自适应融合机制对多分支图表示进行动态整合,以实现对脑区协同连接模式的更精细刻画;第三,设计了时序依赖建模模块。利用双向长短时记忆网络(Bi-directional Long Short-Term Memory,Bi-LSTM)对相邻时间片段进行双向上下文建模,并结合轻量级时序注意力池化突出关键时间步信息,避免简单平均汇聚对关键情绪片段造成同权稀释。

全文HTML

-

本研究提出了一种融合跨域特征交互与感知增强图机制的长短时记忆网络情绪识别模型。该模型旨在模拟大脑在处理情绪信息时多脑区协同与动态演变的复杂机制,重点解决现有方法在多域特征互补性挖掘与脑网络动态拓扑表征方面的不足。CD-PEBL主要由3个核心模块构成:跨域特征交互模块、感知增强自适应图融合模块和时序依赖建模模块。

-

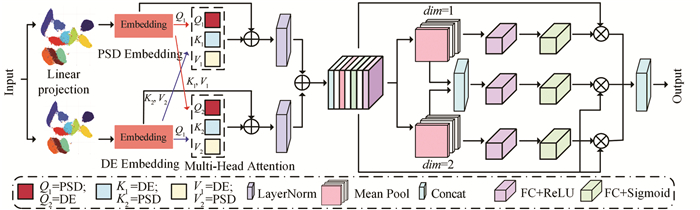

CD-PEBL模型的整体架构如图 1所示。模型面向被试内脑电情绪识别任务,按照“时频特征表征增强—空间拓扑建模融合—时序依赖聚合判别”的流程构建统一框架,以协同刻画EEG的时频互补信息、通道间拓扑关系与情绪演变的动态时序特性。具体而言,模型首先从预处理后的EEG中提取DE与PSD两类基础特征,并输入CDFI进行对齐与融合,以获得更具判别性的跨域增强节点表征。与此同时,模型分别计算通道间的PCC与PLV,构建多视图先验邻接矩阵以表征幅值耦合与相位同步两类连接关系,并将其作为后续可学习邻接矩阵的初始化基础。随后,将跨域增强特征与多视图邻接信息共同输入PEAGF,学习情绪相关的空间拓扑表征。接着,将得到的空间表征组织为时空特征序列并输入BTDM,捕捉情绪诱发过程中的双向时序关联。最后,通过分类器将时序上下文表示映射到情绪标签空间,输出最终识别结果。

-

在特征构建阶段,为了获得同时表征脑电信号时域与频域信息的特征表示,在特征提取之前,首先对脑电信号进行带通滤波,以去除与情绪识别无关的低频漂移及高频噪声成分。随后,采用Butterworth带通滤波器将信号分解为常用于分析的频带:θ(4~7 Hz)、α(8~13 Hz)、β(14~30 Hz)、γ(31~45 Hz)。对每个频带分别提取功率谱密度与微分熵特征。

设某一时间窗内的离散信号为x(n),窗长为L。采用Welch[15]方法估计功率谱密度P(f),计算公式如下:

式中:M为分段数量;xi(n)表示第i段信号;w(n)为窗函数;U为归一化因子;

$ j=\sqrt{-1}$ 为虚数单位。微分熵在脑电情绪识别中常被用作能量类特征的补充。假设特定频带内的脑电信号服从高斯分布N(μ,σ2),其微分熵h(x)定义为:

式中:σ2为该频带信号的方差。

为适配后续Bi-LSTM对时序建模的输入需求,采用分层窗口策略构造特征序列:先将每个长试次切分为长度为Tmacro=1 s的不重叠宏窗,以确保训练集与测试集的数据独立性。再在每个宏窗内部采用长度Tmicro=0.5 s、步长Δt=0.5 s的微窗生成序列。对于每个宏观样本,其内部生成的序列长度Ls计算如下:

最终,对每个时间步、每个通道提取PSD和DE值,构建特征张量

$ \boldsymbol{X} \in \mathbb{R}^{L_s \times C \times D}$ ,其中C为通道数,D为特征维度。 -

为刻画脑电通道之间的空间拓扑关系,利用原始信号计算通道间的相位锁定值与相关系数构建邻接矩阵。采用皮尔逊相关系数衡量通道u与v之间信号幅值的线性相关性,构建幅值邻接矩阵Apcc,其元素ru,v计算如下:

式中:xu(n)为通道u在第n个采样点的信号幅值;

$ \bar{x}_u$ 为该通道信号的均值;L为计算窗口内的采样点数。同时,利用希尔伯特变换提取信号的瞬时相位,计算相位锁定值以衡量非线性同步性。构建相位邻接矩阵APLV,其元素pu,v定义为:

式中:

$ {\rm{j}}=\sqrt{-1}$ 为虚数单位;φu(n)和φv(n)分别表示通道u和通道v在第n个采样点的瞬时相位。为综合利用幅值与相位两类连接信息,采用Hadamard逐元素乘积进行融合,得到初始先验邻接矩阵Afus:

-

在脑电情绪识别中,DE与PSD分别从统计复杂度与能量分布角度刻画神经活动,二者具有一定的互补性。然而,现有工作常采用直接拼接的方式融合两类特征,容易因特征空间异构而导致语义对齐不足,使跨域互补信息难以被显式建模,进而限制特征的判别能力。为此,设计了跨域特征交互模块,具体结构如图 2所示。通过“共享投影—双向交叉注意力—多尺度重校准”的方式实现异构特征的协同增强与动态对齐,从而为后续图结构学习提供更具判别力的节点表示。

设在第s个时间步,DE与PSD的节点特征分别为:

式中:C为通道数;F为单模态特征维度。

首先,使用共享线性映射将两类特征投影到同一隐空间:

式中:

$ \boldsymbol{W}_p \in \mathbb{R}^{F \times d}、\boldsymbol{b}_p \in \mathbb{R}^d$ 为可学习参数,共享投影维度d设为32。随后引入双向交叉注意力实现跨域信息交互:以EDE(s)为查询、EPSD(s)为键和值,得到时域特征的跨域增强表示;反向同理可得到频域特征的增强表示:

式中:LN(·)表示LayerNorm。对多头注意力,单个注意力头可写为:

式中:Q、K、V分别为查询(Query)、键(Key)、值(Value)矩阵,由输入特征经线性变换得到;h为注意力头数;dk为缩放因子对应的维度。

为得到统一的跨域交互特征,将两路增强表示进行融合:

在此基础上,为进一步提升特征鲁棒性并突出关键模式,CDFI设计了三路重校准分支。采用通道重校准分支强调具有情绪区分度的关键电极;用特征重校准分支突出更有效的频带/嵌入维度;用样本级门控分支结合通道与特征的全局统计对样本进行整体缩放。三路输出分别记为

$ \boldsymbol{Z}_c^{(s)}, \boldsymbol{Z}_f^{(s)}, \boldsymbol{Z}_s^{(s)} \in \mathbb{R}^{C \times d}$ ,最终在特征维进行拼接得到模块输出: -

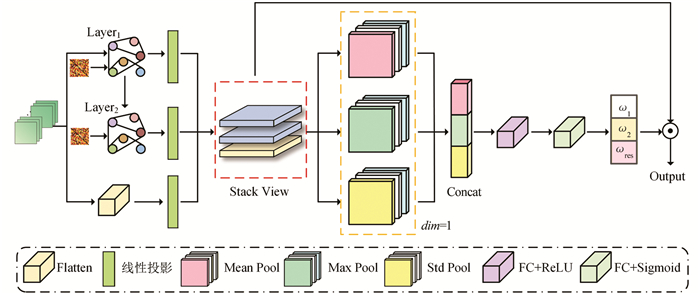

脑电情绪表征不仅依赖单通道节点的局部特征强度,更取决于情绪诱发过程中不同脑区之间复杂的功能连接关系及其协同变化模式。传统图卷积方法通常基于预定义的静态邻接矩阵构建脑网络连接,难以刻画情绪状态变化所引起的动态连接模式;同时,单一尺度的空间传播机制往往难以兼顾局部邻域依赖与跨脑区远程协同,多视图特征若仅通过平均或拼接方式融合,易造成关键判别信息稀释。为此,在先验物理图的基础上构建感知增强自适应图融合模块,如图 3所示。该模块采用残差多视图金字塔图编码获取多尺度空间表征,并在融合阶段引入基于统计量的特征级门控机制,实现对多视图信息的自适应筛选与增强。

CDFI模块输出跨域增强的节点特征,记为

$ \boldsymbol{Z}_{\text {cross }} \in \mathbb{R}^{\left(B \cdot L_s\right) \times C \times F_g}$ ,其中,B为批量大小,Ls为序列长度,C为通道数,Fg为特征维度。为在保留大脑物理连接先验的同时捕捉随情绪状态变化的动态依赖,PEAGF引入可学习的邻接矩阵参数$ \boldsymbol{A}_{\mathrm{dyn}} \in \mathbb{R}^{C \times C}$ 。不同于传统的静态图,将先验矩阵Afus作为网络参数的初始状态,使其在训练过程自适应调整边权。考虑到脑网络连接同时包含局部近邻依赖与跨脑区的远程协同,PEAGF采用两层Chebyshev图卷积主干构建多视图金字塔结构。令初始特征Z(0)=Zcross,并定义Chebyshev图卷积第m层的特征更新算子为:式中:σ(·)为非线性激活;Tk(·)为k阶切比雪夫多项式,满足递推Tk(x)=2xTk-1(x)-Tk-2(x),T0=1,T1=x;Θk(m)与b(m)为可学习参数。

首先构建归一化拉普拉斯矩阵L,其中D为Adyn的度矩阵。为满足Chebyshev多项式谱滤波对特征值范围的要求,对L进行重标定,其中λmax表示L的最大特征值。考虑到归一化拉普拉斯矩阵的特征值通常位于[0, 2]区间内,因此采用λmax≈2的近似[16],从而得到重标定的拉普拉斯矩阵

$ \hat{\boldsymbol{L}}$ :多视图特征经展平与线性投影映射到统一维度,因此两路图分支得到:

式中:φ(·)为投影算子;Wg为可学习的线性投影矩阵。

与此同时,为保留原始特征的直接映射,缓解过平滑问题,引入残差投影分支:

式中:vec(·)表示向量化操作;Wr为可学习的线性投影权重矩阵。

将三路视图堆叠得到:

为避免简单平均融合带来的信息稀释,引入基于统计量的特征级门控融合,提取多视图特征的均值、最大值、标准差构建全局统计特征Sstat:

进而,通过门控网络生成对应3个视图的独立特征级权重矩阵,并将其在视图维度切分为w1,w2,wres∈

$ \mathbb{R}^{\left(B \cdot L_s\right) \times H}$ :式中:σ(·)为Sigmoid激活函数;δ(·)为ReLU激活函数;W1和W2为门控网络的可学习权重。

最终,利用生成的独立权重对各个视图进行逐元素加权融合,得到空间增强特征Hspa:

将Hspa从(B·Ls,H)恢复为(B,Ls,H),输入时序依赖建模模块进行时序建模。

-

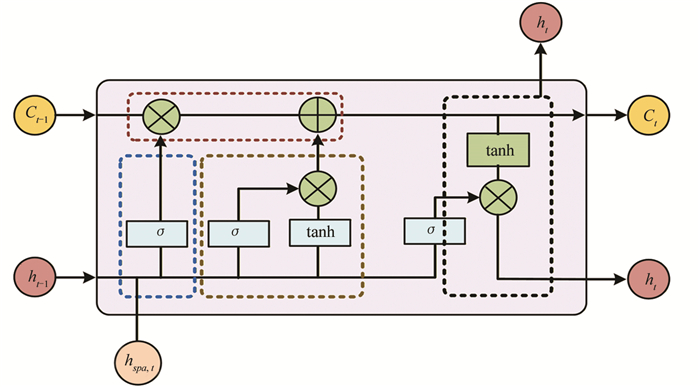

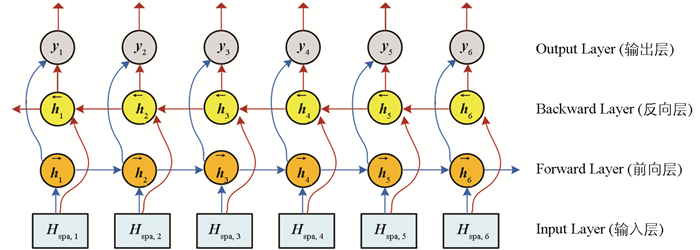

由于个体情绪变化在相邻时间片段间具有上下文关联性,仅依靠空间特征难以捕获这种时序动态特征。因此,构建了基于双向长短时记忆网络的时序依赖建模模块,对PEAGF输出的空间特征序列Hspa,t进行双向时序建模。为了克服传统RNN的梯度消失问题,该模块采用具有门控机制的LSTM作为基础单元,如图 4所示。

设PEAGF输出的空间表征序列为:

式中:T为序列长度;H为空间特征维度。对单向LSTM,在时刻t∈{1,2,…,T}的门控计算为:

式中:Wi为输入门、Wf为遗忘门、Wo为输出门;bi,bf,bo分别为对应偏置项;[;]为向量拼接操作;σ(·)为Sigmoid函数。为完整描述记忆更新过程,候选记忆与细胞状态更新定义为:

式中:

$ \widetilde{\boldsymbol{C}}_t$ 为候选记忆;Wc,bc分别为权重矩阵与偏置项;$ \odot$ 为Hadamard逐元素乘积;Ct为细胞状态;ht为隐状态。为充分利用相邻时间片段间的前后上下文互补信息,进一步采用双向结构,如图 5所示。前向层产生

$ \{\overrightarrow{\boldsymbol{h}}_t\}$ ,后向层产生$ \{\overleftarrow{\boldsymbol{h}}_t\}$ 。将两方向隐状态在特征维拼接得到每个时间步的输出:同时为避免简单均值池化对关键情绪片段的同权处理,引入轻量级时序注意力池化,对{yt}t=1T进行自适应加权汇聚。具体地,先计算每个时间步的注意力得分与权重:

式中:

$ \boldsymbol{W}_a \in \mathbb{R}^{d_a \times 2 H}、\boldsymbol{b}_a \in \mathbb{R}^{d_a}、\boldsymbol{w}_a \in \mathbb{R}^{d_a}$ 为注意力隐藏维度超参数;et、ek为注意力得分;αt为第t个时间步的注意力权重;y为注意力池化的最终输出。通过αt的自适应分配,模型可突出对情绪判别更关键的时间步信息。考虑到双向拼接使特征维度扩展为2H,为与后续分类器输入维一致,进一步采用线性投影将其映射回H维,并结合归一化与非线性激活增强表征能力:

式中:LN(·)为LayerNorm;δ(·)为ReLU;Wt和bp为线性投影层的可学习参数。最终Hfinal作为分类模块的输入完成情绪类别判别。

1.1. 模型整体架构

1.2. 数据预处理与特征提取

1.3. 邻接矩阵的构建

1.4. 跨域特征交互模块

1.5. 感知增强自适应图融合模块

1.6. 时序依赖建模模块

-

为了验证所提出的CD-PEBL模型在脑电情绪识别任务中的有效性与稳定性,本节在2个公开基准数据集上进行了系统实验。

-

DEAP数据集[17]是广泛应用于情绪计算领域的多模态情绪数据集,通过音乐视频片段诱发被试的不同情绪反应。实验招募了32名健康被试完成实验,每名被试均完成全部40段视频的观看流程,同步采集了脑电(EEG)、眼电(EOG)、肌电(EMG)、皮肤电导反应(GSR)等多类生理信号。脑电信号由32通道BioSemi ActiveTwo系统采集,原始数据经官方预处理后下采样至128 Hz,并提供情绪标注信息。每段视频的情绪状态由被试基于唤醒度和效价2个维度进行主观评分,评分范围为1~9分。根据实验设置对DEAP数据集进行进一步处理,将效价与唤醒度评分以5为阈值进行二值化,分为高低2类,仅使用EEG作为模型输入。

SEED数据集[3]由上海交通大学BCMI实验室发布,主要用于研究积极、中性和消极3类离散情绪对应的脑电活动模式。该数据集的情绪诱发实验共招募了15名健康被试(7名男性、8名女性)参与实验,在3个独立实验会话的EEG记录中,每个会话包含15段情绪诱发视频,其中3类情绪各5段,以保证类别均衡。脑电信号由62个通道采集,官方数据已完成伪迹去除并下采样至200 Hz,可直接用于情绪识别算法的训练与验证。实验同样仅使用SEED数据集中的EEG数据进行分析。

-

模型分类性能采用准确率(Accuracy)和F1分数(F1-score)进行评估。模型基于PyTorch框架实现,并在NVIDIA RTX4060 GPU上完成训练。训练过程中采用交叉熵损失函数,批量大小设置为64,初始学习率设为0.000 1,优化器选用Adam,训练轮数设为80轮。

关键超参数设置如下:在跨域特征交互模块中,共享线性投影维度d设为32,多头注意力头数设为2,2个交叉注意力分支分别用于建模双向语义交互。在感知增强自适应图融合模块中,切比雪夫图卷积阶数k设为2,两层金字塔图卷积的感受野可覆盖4跳邻域范围,能够有效建模脑网络中的主要功能连接关系,同时避免过大k值带来的过平滑问题。图卷积隐藏层维度和Bi-LSTM隐藏维度均设为32,以在被试内小样本条件下兼顾模型表达能力与泛化稳定性;注意力池化隐层维度da设为64。这些超参数在多次实验下验证获得较优结果。

-

为验证所提CD-PEBL模型在不同数据集上的有效性与稳定性,在DEAP和SEED 2个数据集上做了被试内10折交叉验证实验,以Accuracy与F1-score作为主要汇报指标,表 1给出了模型在不同任务上的整体测试结果(均值±标准差)。

如表 1所示,CD-PEBL在DEAP(Valence/Arousal)与SEED上均取得较高的性能。同时,Accuracy与F1-score的一致性以及较小的方差表明模型在不同数据集上具有较好的稳定性与鲁棒性,说明模型能够在一定程度上缓解EEG非平稳性带来的影响。

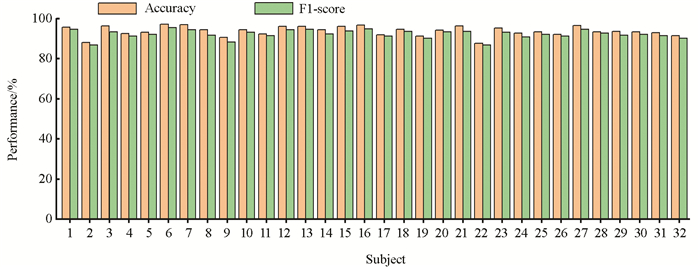

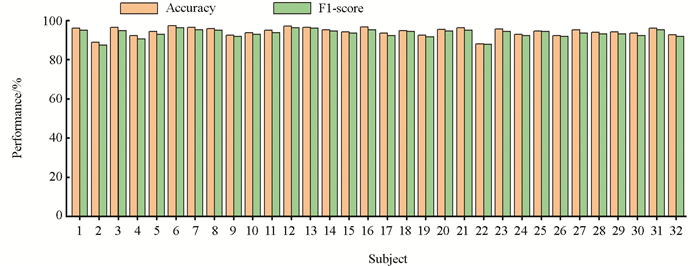

同时为进一步分析模型在不同受试者上的表现差异,统计了DEAP数据集32名受试者的个体实验结果,如图 6、图 7所示。

对32名被试各维度上的分类结果进行统计分析可知,编号为sub06与sub23的被试在效价与唤醒度2个维度上均取得了最优的识别性能,平均准确率均超过97%,表明模型可有效捕捉这部分被试稳定且具有高区分度的情绪脑电模式;而编号为sub22的被试在效价维度的识别性能相对欠佳,其分类准确率较数据集平均水平下降6.71%。上述个体性能差异符合脑电情绪识别研究的普遍规律,其核心原因可归结为不同被试的大脑生理结构及情绪诱发反应模式存在固有的个体异质性,导致情绪相关脑电特征的可分性存在天然差异;此外实验过程中被试的注意力波动、疲劳效应及环境噪声等因素也可能导致部分被试的脑电信号信噪比下降,进而增加分类难度。

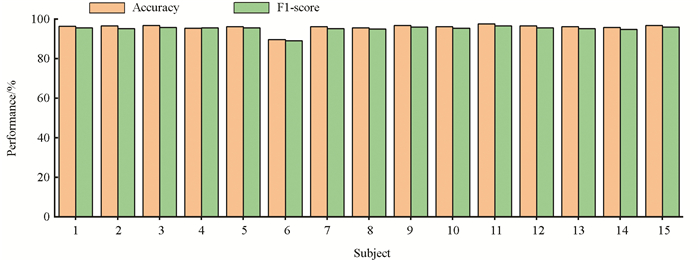

在SEED数据集上,同样对15名受试者进行了被试内个体实验统计,结果如图 8所示。

总体来说,模型在多数受试者上保持较高识别性能,但仍存在少数受试者表现相对偏低的情况。这一现象进一步印证了情绪脑电模式的高度非平稳性与个体特异性。所提出的CD-PEBL通过动态图与时序建模在很大程度上缓解了这一问题。

-

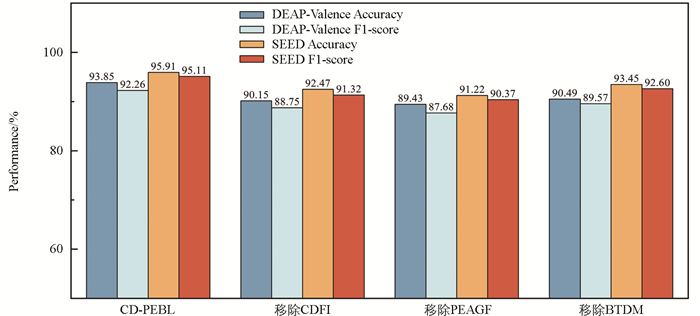

为了定量评估CD-PEBL模型各核心组件对情绪识别性能的贡献,设计了3个变体模型进行对比实验。实验在保持数据集划分、超参数设置一致的前提下,采用控制变量法移除关键模块:①移除跨域特征交互模块,仅对每个通道的DE与PSD特征进行直接拼接,用以检验跨域语义对齐与互补增强机制的贡献。②移除感知增强自适应图融合模块,改用单分支静态图编码器进行空间特征聚合,邻接矩阵在训练过程中保持固定,用以评估动态图建模与多视图融合的作用。③移除时序依赖建模模块,将空间特征直接进行时间维度聚合后输入分类器,从而评估时序上下文信息对情绪判别的贡献。在DEAP与SEED数据集上的实验结果如表 2、图 9所示。

为进一步理清消融实验与引言所述3个设计动机之间的对应关系,以下逐一分析各变体的实验结果。

首先针对跨域特征交互深度不足的问题:移除CDFI后,模型在DEAP-Valence和SEED上的准确率分别下降3.70%和3.44%。该变体仅对DE与PSD特征进行直接拼接,无法显式建模两类特征域之间的互补语义关系。这一显著退化表明,CDFI通过双向交叉注意力机制实现的深层跨域对齐与融合,能够有效弥补单一特征域表征信息不全的缺陷,验证了引言中所指出的浅层融合缺乏对不同特征域之间互补语义显式建模的问题,同时说明所提出方法的有效性。

其次针对动态拓扑建模不足的问题:移除PEAGF导致最为严重的性能下降(DEAP-Valence降至89.43%,SEED降至91.22%)。该变体将PEAGF替换为单分支静态图编码器且邻接矩阵在训练中保持固定,无法自适应地捕捉不同情绪状态下脑区间连接强度的动态变化,也无法从幅值耦合与相位同步2个互补视角综合刻画脑网络拓扑。这一结果表明多视图动态图建模具有重要作用,验证了引言中所指出的单一指标构建邻接矩阵难以同时刻画脑区间同步关系与因果关系的局限性。

最后针对时序依赖刻画不足的问题:移除BTDM后,模型性能出现中等程度下降(DEAP-Valence降至90.49%,SEED降至93.45%)。该变体将空间特征直接进行时间维度聚合后输入分类器,丢失了情绪变化过程中的上下文互补信息。Bi-LSTM的双向时序建模能够同时利用过去与未来的上下文信息,配合注意力池化机制突出关键情绪时间片段,从而有效捕捉情绪演变的时序动态信息。这一结果印证了引言中关于EEG情绪模式随时间动态变化的论述。

综合而言,3个核心模块分别从特征交互增强、空间拓扑建模和时序依赖捕捉3个维度形成互补,各模块的缺失均导致对应维度信息表征的弱化,从而进一步验证了所提方法设计思路的合理性与必要性。

-

为进一步验证所提CD-PEBL模型在脑电情绪识别任务中的有效性与先进性,在公开基准数据集SEED上与多种代表性方法进行对比,包括传统机器学习方法(SVM)以及近年来的深度学习模型(DGCNN、BiDANN、BiHDM、RGNN、4D-CRNN、GLFANet、SOGPCN、GF-MGSFCAFN等)。对比结果如表 3所示。

由表 3可见,CD-PEBL在SEED上取得95.91%的平均准确率,在所列对比方法中表现最优。与传统SVM相比,准确率提升约11.92%,说明深度模型在自动特征学习与时空依赖建模方面具有明显优势。与图神经网络相关方法(如DGCNN、RGNN)相比,CD-PEBL进一步提升了识别性能,反映出跨域特征交互与多视图融合策略对情绪判别具有积极作用。相比近期方法GF-MGSFCAFN,该模型仍取得约0.24%的提升,表明所提出模型在脑电情绪识别任务中具有较好的性能表现。

-

为评估所提CD-PEBL模型的复杂度,从参数规模角度对模型进行了分析,结果如表 4所示。

从总体参数量来看,CD-PEBL在SEED数据集上的总参数量约为40.4万,在DEAP数据集上的总参数量约为24.5万。两者差异主要来源于输入通道数不同所导致的图结构建模规模及特征投影维度差异。从模块参数分布来看,PEAGF模块占据了主要参数量,在SEED和DEAP上分别为34.2万(84.6%)和18.6万(75.6%),说明该模块是模型空间建模与特征融合的主要参数来源。相比之下,CDFI模块参数量较小,在SEED和DEAP上分别为1.4万(3.4%)和1.1万(4.6%),表明跨域特征交互部分具有较高的参数利用效率。BTDM模块在2个数据集上的参数量均为4.8万,分别占总参数量的12.0%和19.7%,说明时序依赖建模模块在增强序列表征能力的同时未显著增加模型复杂度。分类器部分参数量极少,在整体复杂度中可忽略。

综合来看,尽管CD-PEBL包含跨域特征交互、图结构融合及时序建模等多个功能模块,但总体参数规模仍处于适中范围,说明方法性能的提升主要来源于模块设计之间的协同作用,而非单纯依赖参数堆叠。

2.1. 实验数据集

2.2. 实验环境及设置

2.3. 实验结果

2.4. 消融实验

2.5. 对比实验

2.6. 模型复杂度分析

-

针对脑电信号时频特征互补信息挖掘不足、脑电通道非欧几里得拓扑结构建模不充分和情绪演变时序依赖刻画有限等问题,提出了一种跨域交互与感知增强图长短时记忆网络模型CD-PEBL。该模型首先通过跨域特征交互模块实现DE与PSD特征之间的语义对齐与互补增强;随后,借助感知增强自适应图融合模块对多视图、多尺度的空间拓扑信息进行建模,并通过统计感知门控机制实现不同图分支特征的自适应融合;最后,结合Bi-LSTM与轻量级注意力池化构建时序依赖建模模块,有效捕捉情绪变化过程中的双向时序关联。通过上述设计,模型实现了对EEG情绪信息的时空协同建模,并在个性化情绪识别任务中表现出较好的识别性能与泛化稳定性。

实验结果表明,该方法在特征表征、空间建模和时序建模等多个层面均具有明显优势。首先,在特征表征层面,DE与PSD 2类特征在情绪表达中具有较强的互补性,所设计的跨域特征交互模块能够促进两类特征的深度融合,生成更具判别性的情绪表征。其次,基于SEED和DEAP 2个公开数据集的对比实验结果表明,该方法具有良好的有效性和稳定性。通过消融实验对模型各核心组件的作用进行了系统分析,结果表明,CD-PEBL中各组成模块均对整体性能提升具有积极作用。其中,跨域特征交互模块增强了异构特征之间的信息协同,感知增强图融合模块提升了脑电通道空间拓扑特征的表达能力,时序依赖建模模块则有效强化了对相邻时间片段间时序上下文信息的建模能力。此外,模型复杂度分析表明,CD-PEBL在引入跨域交互、图结构融合及时序建模等多个功能模块的同时,整体参数规模仍处于适中范围,表明其性能提升主要来源于模块设计的有效协同,而非单纯依赖参数堆叠。

综上,所提出的CD-PEBL模型为脑电情绪识别中复杂空间拓扑结构与时序动态特征的联合建模提供了一种有效思路。未来的研究将进一步围绕模型轻量化与计算效率优化展开,探索其在资源受限设备上的部署可行性,并进一步评估模型在跨被试、跨会话等更复杂场景下的泛化能力。

下载:

下载: