-

开放科学(资源服务)标识码(OSID):

-

高光谱图像是一种通过在大量连续波长范围内采集数据来获取物体表面光谱信息的图像,因其具有丰富的光谱信息,能更精准识别其他图像无法区分的细微材料。地表相关信息对农业生产具有重大意义,其研究需要运用高光谱图像,例如适宜的土壤能够生产出更加优质的烟草[1-2]和茶叶[3],不同的土壤能够让辣椒产生不同的营养和风味品质[4],精准的陆面资料能够降低地区天气和降水的模拟误差[5],生态系统碳储存功能与景观格局变化有着极大相关性[6]等。然而高光谱图像具有空间分辨率较低,图像中普遍存在混合像元的问题,因此对下游任务的开展将带来不利影响。高光谱解混技术的研发,其目的就是将高光谱图像中高度混合的像元分解成纯物质的光谱(即端元)和纯物质所占像元的比例(即丰度)。高光谱解混技术的大量研究和应用主要基于2个不同的混合模型,即线性和非线性混合模型[7]。线性混合模型假设入射光只与一种物质产生作用,其混合光谱可以表示为纯物质光谱的线性组合。非线性混合模型考虑到了多种物体之间的多次反射,更符合实际情况,但面临着缺乏适当的非线性程度以及先验知识相关方面的挑战。

随着大数据时代的来临,深度学习迅速发展,并已用于高光谱解混任务中[8]。与传统的解混方法相比,深度学习可以在任意网络结构组合以及非线性结构上实现,具有更高的适用性与灵活性。自动编码器(Auto Encoder,AE)是高光谱解混方法中典型的基于深度学习方法的基本网络结构,其主要分为编码器和解码器2个部分。编码器主要用于提取隐藏层的低维特征来进行丰度估计,解码器主要用于将低维特征重构为原始输入数据并获得端元矩阵。目前,已经有学者提出许多基于AE方法的变体。例如:Palsson等[9]提出了一种深层AE来进行高光谱解混,并验证了不同激活函数对AE的作用;Shi等[10]针对现有方法对光谱变异性建模能力的不足,提出了一个概率生成模型来解决端元变异性问题,并通过神经网络的非线性建模功能来拟合任意端元分布,进而提供更准确的丰度和端元估计。然而,高光谱图像中的相邻像素间往往表现出高度的空间相关性,上述方法并没有充分考虑空间信息。因此,Palsson等[11]提出了一种基于卷积AE的解混方法,该方法直接使用高光谱图像块,并且不使用任何池化或上采样层,因此始终保留了图像的空间结构。Yu等[12]受感受野机制和多级框架有效性的启发,提出了一种用于高光谱解混的多级卷积AE网络,能够通过卷积AE在逐步多级分解过程中学习广泛的上下文信息而不丢失细节特征。过去也有一些学者尝试解决这些问题,例如Ghosh等[13]将卷积AE与Transformer相结合,提出了一种新颖的基于深度神经网络的Transformer高光谱解混模型,使Transformer在视觉领域中建模全局上下文信息得到成功应用[14]。但目前大多数基于AE的解混方法都是纯粹基于卷积神经网络(Convolutional Neural Network,CNN)提出的,而CNN又受卷积核大小的限制,容易丢失原始图像中的大量上下文信息,使其在处理高光谱图像的复杂性问题上面临较大的挑战。

近年来,许多学者也通过Swin Transformer和三维CNN的结合来进行光谱信息处理,例如Ma等[15]使用Transformer代替CNN来学习HSI(Hyperspectral Image)的先验,然后在Transformer层后面添加了三维CNN探索HSI的空间光谱相关性,使得在2个广泛使用的HSI数据集和真实世界数据集上实现了相当大的增益。Farooque等[16]提出了一种以处理HSI立方体作为输入,并采用涉及具有不同Atrous速率的三维层并行分支光谱空间特征提取模块的方法,该方法能够以多种尺度和分辨率提取特征,并在多个HSI数据集上取得一定的优越性。但是使用Swin Transformer和三维CNN结合的方法依然是针对HSI的2种特征进行直接融合或拼接,对于深层融合时出现的特征冗余现象的处理存在一定不足。

为此,本文提出一种综合考虑全局上下文信息的双分支网络结构,其中空间特征提取模块利用Swin Transformer建模全局空间上下文信息[17],光谱特征提取模块利用三维CNN进行光谱信息的建模,而光谱空间自注意力模块进一步提取全局深度融合的上下文信息,最后在2个真实数据集上通过消融实验和对比实验进行验证。

全文HTML

-

对于线性混合模型,高光谱图像解混的过程可以根据如下公式进行表示:

式中:Y∈RL×N为包含L个波段和N个像素的被观测到的高光谱图像;M∈RL×p为端元矩阵,其中端元矩阵的每一列表示1个端元的光谱;A∈Rp×N为相应的丰度矩阵;N∈RL×N为添加的噪声向量。此外,丰度矩阵代表每个像元中各个端元所占的比例,所以丰度矩阵需要同时满足丰度和为一约束(Abundance Sum-to-one Constraint,ASC)和丰度非负约束(Abundance Nonnegativity Constraint,ANC),相应的公式如下:

式中:ai为第i个像素;ai,j为第j个端元在第i个像素中所占的比例;p为端元数目。

-

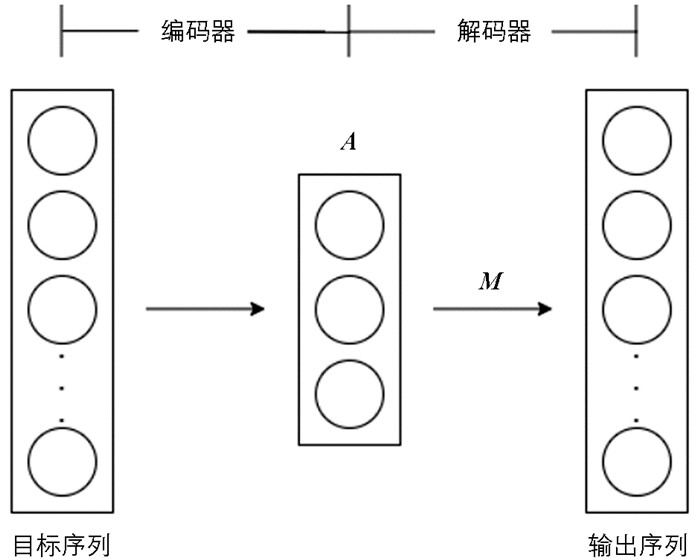

基于AE的结构因适合于解混任务而被广泛应用。如图 1所示,编码器部分(Encoder)用来对原始高光谱图像提取图像特征,同时将高维的数据转换成位于隐藏层的低维特征。解码器部分(Decoder)则通过学习隐藏层的低维特征来重构高光谱数据。利用原始高光谱数据和重建高光谱数据之间的误差可以很好地训练AE。其中,隐藏层的低维特征A代表丰度矩阵,解码器部分的权重M代表端元矩阵。

此外,基于AE的解混方法通常使用ReLU激活函数和Softmax激活函数来满足ASC和ANC,相应的公式如下:

1.1. 线性混合模型

1.2. 基于AE解混的原理

-

双分支网络模型能够解决现有高光谱解混方法的不足之处,它既能充分保留原始上下文信息,又能有效避免卷积核过小的问题。下面分别介绍其网络结构以及所采用的损失函数。

-

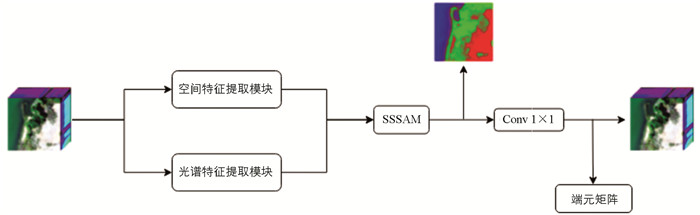

与常规AE一样,本文的方法主要包括编码和解码2部分。图 2呈现了所提出的高光谱双分支网络(Hyperspectral Double-branch Network,HDN)整体架构。首先,编码部分通过双分支网络结构获得光谱和空间特征,这部分将在第2.2节中详细阐述。随后是光谱空间自注意力模块SSSAM(Spectral Spatial Self-attention Module),将在2.3节中详细阐述。通过引入空间特征提取模块和光谱特征提取模块,该网络能够同时获取光谱和空间上下文信息,并通过自注意力模块SSSAM进一步提升全局上下文信息的建模能力。最后,解码部分使用简单的1×1卷积进行维度调整以获取重构的输入。

-

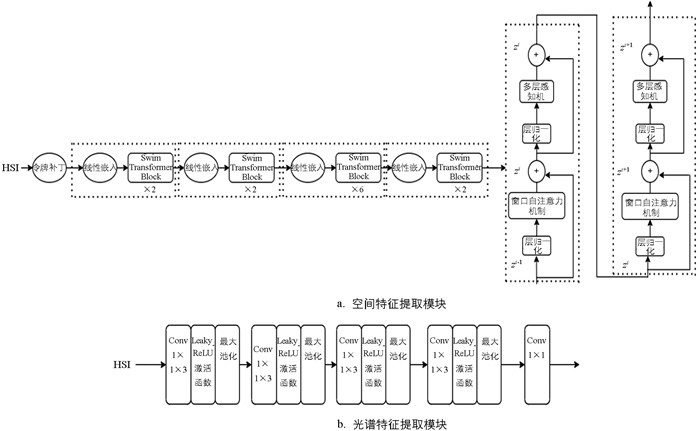

与其它图像不同,高光谱图像可理解为一个三维图像,其中包括空间维度与光谱维度。现有方法针对AE进行较多改进,但都是基于二维卷积来考虑空间信息从而忽略了光谱维度的信息,这就对解混性能造成负面影响。受Yu等[12]以多尺度信息为基础提出一种多级卷积AE思路的启发,本文提出一种双分支网络结构(图 3),该网络结构将同时考虑高光谱图像的空间信息和光谱信息。

如图 3a所示,本文利用Swin Transformer作为双分支网络结构中的空间特征提取模块,该模块以整个高光谱图像作为输入并将其划分成若干个不重叠的令牌补丁,然后这些令牌补丁经过若干次重复的Transformer Blocks以进行空间信息长程相关性建模,最后重塑维度得到与丰度图相同的尺寸。

如图 3b所示,对于光谱信息提取模块,本文使用1×1×3的三维卷积进行光谱信息提取,每个三维卷积后使用Leaky_ReLU激活函数以及最大池化,最后使用1个1×1的二维卷积将通道数调整至对应数据集的端元数量。第i层和第j层特征图神经元值的具体公式如下:

式中:g为激活函数;wi,j,τ为第i层和第j层特征图中权重参数的值;bi,j为对应的偏置,dl-1为特征图的数量。通过2ρ+1、2γ+1以及2η+1可分别计算卷积核的宽、高与深度。

-

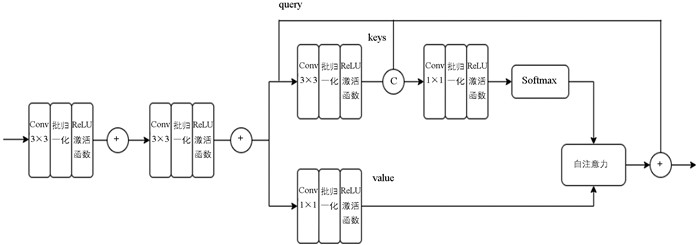

近年来,注意力网络能够帮助网络模型减少特征的冗余,使模型更加聚焦于重要的目标区域,所以在计算机视觉领域应用广泛。考虑到高光谱图像的波段数量较多且普遍存在波段信息冗余的问题,以及传统Self-attention虽能进行不同空间位置的特征交互,但大多数仍通过计算(query,keys,value)三元组的交互获得全局注意力信息,这并没有考虑相邻键值对之间的丰富上下文信息,因此本文将上下文信息与Self-attention的学习结合在一起,形成光谱空间自注意力模块,如图 4所示。

由图 4可知,该模块首先经过2个3×3卷积核进行空间信息提取,同时卷积核使用批归一化(BN)和ReLU激活函数。此外,为防止梯度爆炸或梯度消失的问题,本文引入残差连接以帮助网络训练。接着通过3×3卷积核对上下文进行编辑以获取相邻图像的局部信息,随后与原输入进行通道维度的拼接操作。进一步经过1个1×1卷积学习多头注意力矩阵,再进行Softmax操作以得到注意力权重矩阵A,此时A中每个空间位置都考虑到了全局特征。权重矩阵A再与Value Map进行Self-attention计算,获得图像全局信息,以实现输入的动态上下文表示。最后将所得的局部信息与全局信息进行相加融合,得到了对突出点着重关注的输出特征。

-

光谱角距离(Spectral Angular Distance,SAD)是尺度不变的目标函数,因而使用光谱角距离作为网络损失函数的第1项,其公式如下:

式中:Ii和

$\hat{I}_i$ 分别为原始高光谱数据和模型所重建的高光谱数据;p为数据个数。光谱角距离虽有利于端元的提取,但没有考虑到丰度估计的偏差,所以第2项损失使用均方误差(Mean Square Error,MSE),其公式如下:

总损失为这2项损失的加权和,即:

式中:∂为权重系数,用于控制2项损失函数之间的平衡。

2.1. 网络结构

2.2. 双分支特征提取模块

2.3. 光谱空间自注意力模块

2.4. 损失函数

-

实验中训练模型使用的处理器型号为Intel Core i9-13900HX,显卡为8 GB的RTX4060。本方法模型使用Python 3.7和PyTorch 1.11深度学习框架进行编写,其训练参数如表 1所示。

-

实验中使用的高光谱数据集描述如下:

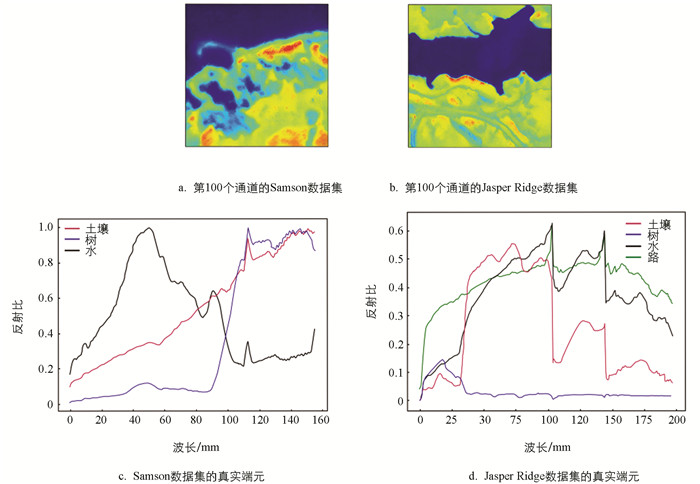

1) Samson数据集:原始高光谱数据的空间分辨率为952×952,为了便于实验分析,从原始图像的第(252,332)个像素开始,该数据集在第100个通道的可视化如图 5a所示,真实端元曲线可视化如图 5c所示。

2) Jasper Ridge数据集:原始高光谱数据有512×614个像素,同样为了便于实验分析,从原始图像的第(105,269)个像素开始,去除易受密集水蒸气及大气影响的波段通道:1~3、108~112、154~166和220~224,该数据集在第100个通道的可视化如图 5b所示,真实端元曲线可视化如图 5d所示。

本实验的其他详细参数如表 2所示。

-

为了评估解混性能,该领域常常使用以下4个指标进行评估:均方根误差ERMSE、光谱角距离DSAD、平均均方根误差ARMSE与平均光谱角距离ASAD。ERMSE与ARMSE越低表示模型估计的丰度图更准确,DSAD与ASAD越低表示模型提取的端元更准确,其表达式如下:

式中:

$\hat{a}_{i, j}$ 和ai,j分别为第i个像元中第j个端元的丰度估计比例和真实丰度估计比例;N为像元的数量;p为端元数量;$\hat{e}_i$ 和eiT分别为模型提取的端元和数据集的真实端元。 -

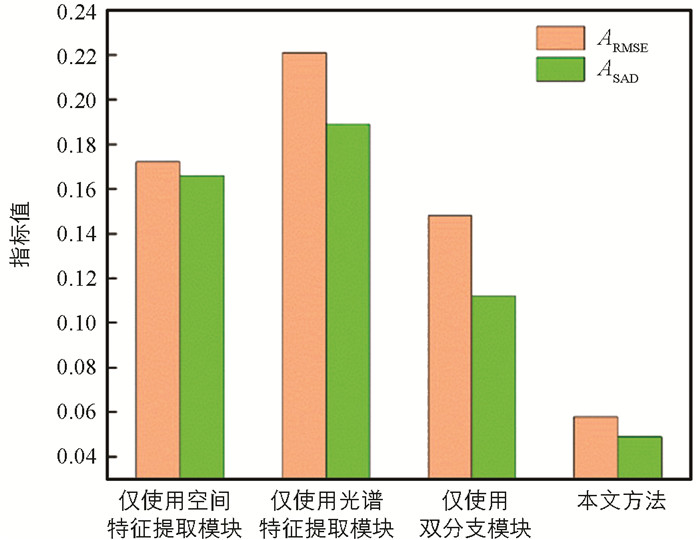

为了验证本方法提出模型中各个模块的有效性,在Samson数据集上进行消融实验。将本文提出的模型拆分为:仅使用空间特征提取模块、仅使用光谱特征提取模块、仅使用双分支模块(空间特征+光谱特征提取模块),并与本文最终的模型(空间特征+光谱特征提取模块+光谱空间自注意力残差模块)进行对比,结果如图 6所示。

在图 6中,横坐标表示各个模块,纵坐标表示综合衡量指标数值,本文将平均均方根误差ARMSE和平均光谱角距离ASAD作为衡量指标,可以看出仅使用光谱特征提取模块或空间特征提取模块因提取的特征信息不够充分,其表现不佳。当使用双分支模块进行联合信息提取时,解混性能得到了一定改善。当所有模块进行组合时,本文的方法获得了最好的结果,进而证明了本文方法的有效性。

-

本文选用5种深度学习方法进行对比实验,然后对结果进行定量分析,验证本文提出方法的有效性,包括:DAEU[9]、CyCU-Net[18]、DeepTrans[13]、MSNet[12]、DAAN[19]。DAEU采用全连接层构建AE,CyCU-Net级连了2个卷积AE,DeepTrans将transformer模型引入基于卷积编码器的解混方法中,MSNet采用多阶段卷积神经网络用于解混,DAAN则是一种基于去噪的深度AE增强网络。此外,上述方法均使用顶点成分分析(Vertex Component Analysis,VCA)[20]来初始化端元矩阵。

-

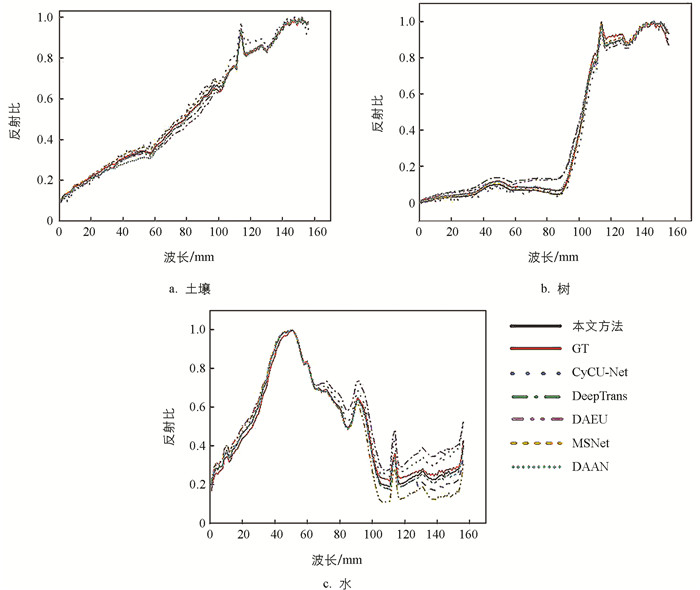

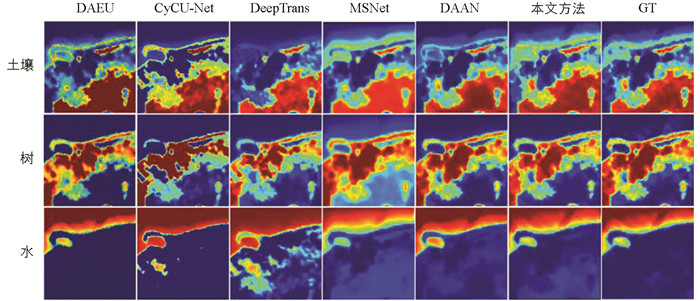

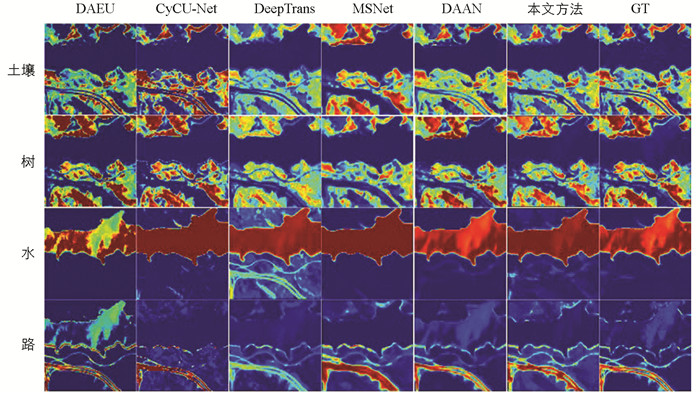

上述5种深度学习方法和本文提出的方法在Samson数据集上的定量分析结果如表 3所示。根据表 3的数据可以看出,本文提出的方法在土壤、树、水3种要素的丰度估计上分别最高提升了38.89%、28.57%、4.41%,端元提取上分别最高提升了3.51%、33.33%、6.90%。图 7显示了所有方法在Samson数据集上的端元提取结果,其中图 7a、7b、7c分别对应于端元:土壤、树、水。从图中的走势分析可知,在不同的波段上各方法均有一定的差异,但只有本文提出方法得到的整体结果最接近真实标签(GT)。图 8为所有方法在Samson数据集上的丰度估计结果可视化图,可以看出本文提出方法的效果也与GT最为接近。

-

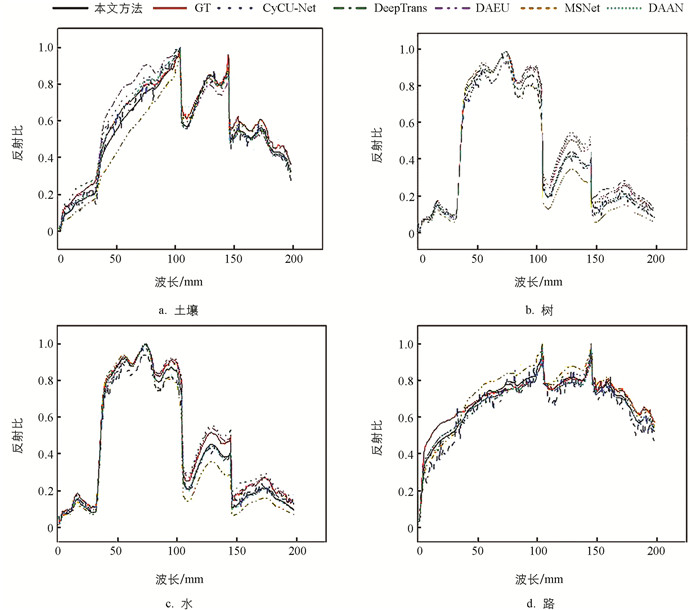

在Jasper Ridge数据集上的定量分析结果如表 4所示。根据表 4的数据可以看出,本文提出的方法在土壤、树、水、路4种要素的丰度估计上分别最高提升了12.98%、25.00%、11.43%、19.21%,端元提取上分别最高提升了7.69%、39.22%、8.45%、2.70%。图 9显示了所有方法在Jasper Ridge数据集上的端元提取结果,其中图 9a、9b、9c、9d分别对应于端元:土壤、树、水、路。从图中的走势分析可知,本文提出方法得到的整体结果最接近GT。图 10为所有方法在Jasper Ridge数据集上的丰度估计结果可视化图,可以看出本文提出方法的效果也与GT最为接近。

3.1. 实验设置

3.2. 高光谱数据集描述

3.3. 评估指标

3.4. 消融实验

3.5. 定量结果分析

3.5.1. Samson数据集的实验结果分析

3.5.2. Jasper Ridge数据集的实验结果分析

-

针对深度神经网络方法在高光谱图像解混研究中的不足,本文提出了一种结合二维和三维卷积的双分支网络模型,以提升解混性能。该网络模型包含3个模块,首先通过Swin Transformer构建的空间模块和三维卷积构建的光谱模块分别进行高光谱图像空间特征和光谱特征的提取,然后通过光谱空间自注意力残差模块进行空间特征和光谱特征的深度融合以获得联合特征信息。在Samson数据集和Jasper Ridge数据集上进行实验,以验证模型的有效性。采用均方根误差ERMSE、光谱角距离DSAD、平均均方根误差ARMSE与平均光谱角距离ASAD作为评估指标,结果表明在丰度估计上分别平均提升了18.31%与2.70%,在端元提取上分别平均提升了2.00%与8.24%,证明了本文方法可以有效地提升高光谱解混的性能,对于地表相关信息能够更加精准地进行分析。

下载:

下载: