-

不同成像机制得到的医学图像具有不一样的影像特性,例如CT用来显示非金属植入物和骨骼致密结构,并且在图像的显示过程中失真相对较少[1];MRI可以更好地观察病理软组织;而PET可以测量体内某一个部位的代谢活动量.为了对疾病进行全面、准确的诊断与治疗,单一种类的图像很难提供足够的判断依据,需要结合多种图像综合起来分析.因此,将不同类型的医学图像进行融合,可以获得更全面、更准确的输出图像,为疾病诊断与精确治疗等方面提供参考.例如MRI-US前列腺穿刺活检,PET-CT肺癌检测,MRI-PET脑疾病检测,CT-SPECT乳腺癌检测[2]. MIF作为一种模态医学影像的处理技术,可将不同的信息进行有效整合.结合各图像的互补信息,显示更清晰的细节.因此,如何获得细节丰富、信息全面的融合医学图像成为当前迫切需要解决的问题.

随着计算机技术的发展,学者们提出了多种MIF算法,例如基于金字塔分解(Pyramid Decomposition,PD)的算法、基于小波变换(Wavelet Transform,WT)的算法、基于Curvelet变换与变换的算法、基于PCNN[3]等融合技术的算法.但PD技术存在冗余性[4],其分解层间的关联性降低了其效果. WT具有良好的空频局域性[5],并且可通过伸缩平移对图像进行多尺度分解. WT与PD不同之处是,WT具有方向性,且不含冗余信息.所以,基于WT的融合算法具有优异的融合性能.但是,2维WT只能得到水平、垂直、对角线3种子带,导致其获取的方向信息不足,无法准确表示某些细节信息.近年来,有学者将Curvelet变换与Contourlet变换应用于图像融合[6-7]中,两者均具有多尺度性、多方向性,取得了较好的融合性能.但是Contourlet变换采用了分解,缺乏平移不变性,易出现伪Gibbs问题.另外,神经网络在MIF方面得到了应用.如基于PCNN的MIF技术[8],由于PCNN具有整体耦合、同步脉冲等优点,使其具有理想的融合性能.但是,PCNN存在多变量,以及融合准则等设定问题,影响了其在图像融合中的使用.

为了解决上述图像融合方法的不足,本文根据加权融合法,提出了一种基于峰值皮层模型耦合WLD的医学图像融合算法.根据峰值皮层模型的邻域神经元所产生的脉冲输出的多特征进行权重计算,而不是单个神经元的脉冲输出特征.邻域神经元产生的脉冲输出的多特征包括可以表征源图像的灰度信息,再利用脉冲图像生成点火映射图像(Ignition Mapped Image,IMI),构建SCM脉冲输出点火数的融合准则.随后,结合SCM脉冲输出的信息熵与点火映射的Weber局部描述WLD,根据信息熵与WLD的相似性计算融合权重.相比基于PCNN融合的方法,本文提出的峰值皮层模型具有更高的计算效率,参数设定简单,细节丰富,符合人体视觉系统等优点,使其可以更好地保存源图像的细节特征.最后,测试本文融合算法的性能.

HTML

-

PCNN具有整体耦合、脉冲同步性[9]等优点,在图像融合方面取得了很大进步.但是其参数设置较多,难以获得优异的效果.通过对PCNN的不断研究,人们提出了一种峰值皮层模型(SCM),SCM保持了PCNN的特性,同时简化了模型,降低了参数设置.

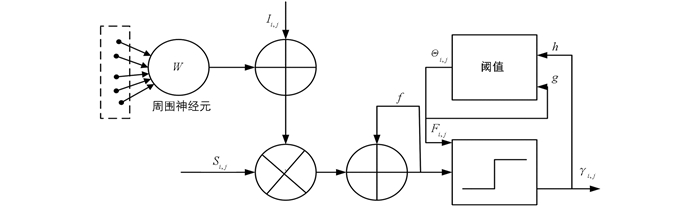

峰值皮层模型的结构见图 1,每个单元Si,j在(i,j)处表示图像中的一个像素;Ii,j作为输入的归一化强度,相邻单元作为连接输入的局部刺激. Si,j中的馈送输入Fi,j和类似输入结合在一起作为内部活动.神经元Si,j将信号和脉冲输出一起输出,上述过程可以表示为[10]

其中,f,g为衰减系数,h为阈值放大因子;n为迭代次数;γi,j[n]为脉冲输出;Θi,j[n]为动态阈值.

通过迭代计算,SCM神经元可输出二进制脉冲图像的时间序列,该序列包含许多有用的输入图像信息.为了更好地解释这一点,图 2显示的是在f=0.9,g=0.3,h=20,nmax=7的情况下所计算输出的二值图像,如图 2a所示.在图 2中,可以看到,在不同的迭代过程中,输出的二值图像包含不同的图像信息,并且包含不同SCM的重要信息,例如输入图像的段和边.另外,从图 2中还可知,SCM可以描述人类的微观组织,具有更高的描述能力.

在SCM网络中,无激活时,Θi,j[n]的值为0,不进行脉冲触发.当Fi,j[0]与γi,j[0]均为0时,进行一次脉冲,得到了内部项Si,j,通过不断迭代,Si,j的能量不断增加,当Si,j的能量大于Θi,j[n]时,触发脉冲,进行点火.

SCM符合人体视觉的神经网络结构,在外部激励下,可完成脉冲同步触发,能够较好地提取输入图像的源信息.并且具有参数少、计算复杂度低等优点,具备完善的数学理论基础,更接近视觉神经元的生物特性.

-

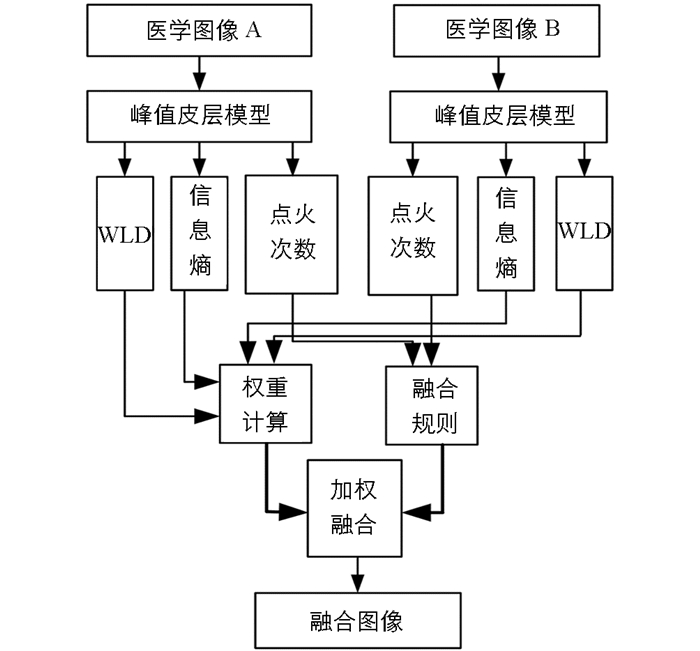

本文提出的峰值皮层模型耦合WLD的医学图像融合算法过程见图 3.该方法的关键部分为图像的融合准则与融合权重计算.在本文算法中,根据SCM脉冲输出的点火次数建立融合准则,权重计算是根据2个源图像之间的相似性,并充分结合点火映射图像输出的WLD与信息熵.

首先,利用SCM对源图像进行变换,得到一系列的二进制脉冲图像.通过脉冲图像生成点火映射图像,构建SCM脉冲输出点火数的融合准则.对于图像A和B中坐标为(i,j)的图块,计算图像多次迭代所输出的熵,生成2个特征向量Vi,jA和Vi,jB.然后,根据2个特征向量之间的差异,计算中心为(i,j)的2个图块Qi,jA和Qi,jB之间的相似矩阵Si,jEn.对于在2个点火映射图像中(i,j)处的任何像素,分别计算像素中心的2个图块的局部能量Ei,jA和Ei,jB.再计算2个图块的WLD,通过Qi,jA和Qi,jB计算相似矩阵Si,jWLD.最后,计算Si,jEn与Si,jWLD的融合权重.

-

为了获得适合的权重wi,j,需要全面考虑源图像中(i,j)处大小为(2Lp+1)×(2Lp+1)的局部相邻域Qi,j(图像块),依据2个图像块相邻域Qi,jA和Qi,jB的相似性来计算权重.为了有效地确定这种相似性,需要同时利用Qi,j的灰度信息与显著性特征.因此,对于脉冲输出的信息熵和Weber局部描述符分别采用Qi,j的灰度分布与显著性特征来描述.

对于第n次迭代的脉冲图像像素(i,j),计算其大小为(2Lp+1)×(2Lp+1)的图像块Gi,j[n]的中心.利用熵Hi,j[n]来描述Gi,j[n]中包含的信息,其函数为[11]

其中,Pi,j1[n]和Pi,j0[n]分别为对数为1和0的表达式. Pi,j1[n]定义如下:

其中,Ki,j[n]表示Gi,j[n]中对数为1的数量.

随后,利用不同迭代次数得到的熵值来形成不同的特征向量Vi,j(Vi,j={Hi,j[1],Hi,j[2],…,Hi,j[Nmax-1],Hi,j[Nmax]}).从公式(4)中可得出,所有源图像块Qi,j为同质区域,因此,所有迭代的熵Hi,j[n]都为0,这是因为Pi,j1[n]=1或者Pi,j0[n]=1,将产生一个0向量Vi,j.另一方面,因为Hi,j[n]迭代次数不会为0,Vi,j将包含非零元素,其值取决于灰度分布Qi,j.根据上述分析,灰度信息Qi,j可以被Vi,j特征化.因此,可从Qi,j中来提取Vi,j特征.

再根据2个图像块的Vi,j,获取其特征Di,j为

其中,‖·‖2为Euclidean范数.

根据Di,j的不同,Qi,jA和Qi,jB之间熵的信息相似度Si,jEn为

其中,CS1是一个变量,因Di,j是2个特征向量Vi,j的差值,而Vi,j与迭代次数有关,因此,CS1的取值与最大迭代次数Nmax密切相关,其计算函数为CS1=2*Nmax,CS1越大,则Si,jEn越大,可获得更大的权重;反之,Si,jEn越小.但是,较大的CS1会增加其计算量,在本文实验中,取Nmax=20,也就是CS1=40.

并根据IMI矩阵中TA和TB的像素(i,j)来计算当前像素与其相邻图像块(2Lp+1)×(2Lp+1)之间的差异Ri,j,其计算函数为[12]

根据式(8)可看出,Ri,j的计算与Laplacian相似,遵循Weber定律,对于WLD当前的像素差分激励ξi,j为[12]

其中,反正切函数主要用来控制差分激励的大小,以确保WLD的描述能力.

WLD可以很好地表示局部邻域的显著性.对于IMI,WLD运算可以很好地展现源图像中局部图像的结构特征,该特征有利于对不同的成像方式进行医疗诊断.通过提取的显著特征,确定源图像中Qi,jA和Qi,jB的相似性Si,jWLD为

其中,CS2是一个常数,其大小与WLD(P,R)描述符中的R有关,本文取CS2=4*π,也就是R=4,此时对应的WLD具有较好的描述能力,能更好地描述其局部显著性.

为了确定加权融合的权重,本文结合Si,jEn与Si,jWLD,得到权重wi,j为

通过公式(11)可知,以(i,j)为中心的源图像中的2个图块具有相同的局部结构,这就意味着对于相同的WLD,ωi,j将通过与源图像中图像块的强度分布有关的Si,jEn来决定.因此,ωi,j可表示灰度信息与局部结构的结合关系,有效地处理2幅图像的相似性问题.

-

假设输入图像A与B,作为SCM正规化的外部刺激.通过进行Nmax次SCM迭代计算,可获得每个源图像在像素(i,j)处的点火次数Ti,jA和Ti,jB,

根据所得到的点火次数Ti,jA和Ti,jB,得到2个FMI所需要的2个矩阵TA和TB.对于参数Nmax,太小或者太大的Nmax,易产生较少的重要图像细节.一个合适的Nmax可以很好地表示源图像中的细节,这对于MIF意义非凡.通过多次试验,本文取Nmax=20.

对于IMI中的TA和TB矩阵的每个像素(i,j),在其像素中心2个大小为(2Lp+1)×(2Lp+1)的图块,都将被认为是可以代表该图块的统计特性,该特征比独立的像素特征更有利于源图像的有效融合.故本文用Ei,jA和Ei,jB2个局部能量来表示二者的统计特征Ei,jA和Ei,jB,即

由于图像融合是充分利用2幅源图像的有效信息,通过这些信息进行互补来提高复原图像的质量.因此,在不同情况下,每幅图像的有效信息的贡献度是不同的,根据文献[13]~文献[14]的研究成果可知,利用加权方法来完成图像融合,能够有效地避免融合失真,故本文根据Ei,jA与Ei,jB之间的关系,根据式(11)计算的权重,设计了融合规则:

式中,Ii,jA和Ii,jB分别表示在源图像A和B中(i,j)处的像素;ωi,j表示权重,其在融合过程中具有非常重要影响,因为wi,j决定融合结果的贡献值.为保证良好的图像融合结果,ωi,j一般采取较大值来突出Ii,jA的贡献,此时Ei,jA>Ei,jB,否则将采用相对较小ωi,j值来强调Ii,jB的贡献.

-

1) 输入2个源图像的SCMs,然后运行SCM直到Nmax次,通过公式(1)~(4)可以获得源图像的二元脉冲图像序列;

2) 对于图像A和B中坐标为(i,j)的图块,通过公式计算输出加强图像多次迭代的熵,生成2个特征向量Vi,jA和Vi,jB.根据2个特征向量之间的差异,计算(i,j)处2个图块Qi,jA和Qi,jB之间的相似矩阵Si,jEn;

3) 2个输出脉冲图像被用来生成点火映射图像.对于在2个FMI中(i,j)处的任何像素,分别用公式计算像素中心的2个图块局部能量Ei,jA和Ei,jB.同时通过计算2个图块的WLD来决定Qi,jA和Qi,jB之间的相似矩阵Si,jWLD;

4) 计算Si,jEn与Si,jWLD的融合权重;

5) 根据Ei,jA与Ei,jB的关系,通过叠加2个源图像的权重来生成融合图像.

2.1. 权重计算

2.2. 融合规则

2.3. 算法描述

-

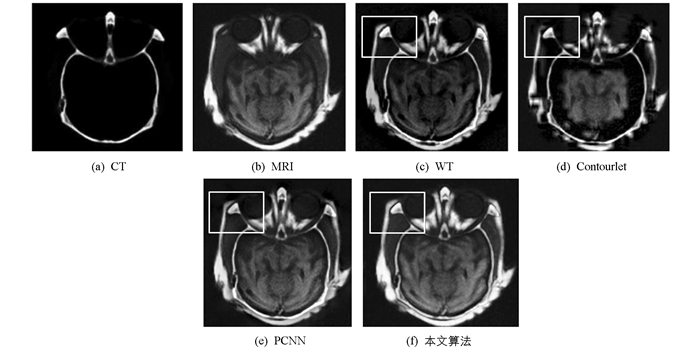

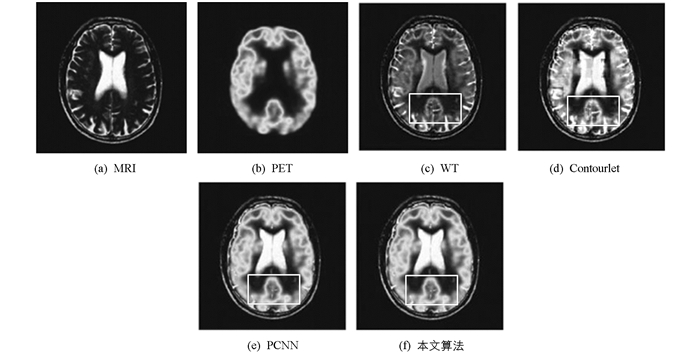

为了衡量本文算法的有效性,进行了2组测试:(1) CT与MRI融合;(2) MRI与PET融合.测试图像大小为256*256.仿真环境为:Intel I5,2.3 GHz四核处理器,500GB硬盘,8GB内存,Windows 8系统,仿真软件为MATLAB 2012.为体现提出方法的先进性,通过与当前流行的3种MIF方法对比:文献[5]中的基于小波变换方法;文献[7]中的基于Contourlet变换方法;文献[8]中的基于PCNN方法,分别标记为WT方法、Contourlet方法、PCNN方法.实验中的参数设置如下:g=0.3,h=20,f=0.9,LP=1,CS1=2*Nmax,CS2=4*π,Nmax=20.

-

为了对融合图像定量评价,通过常见的4种指标:信息熵(IE)、交互信息(MI)、平均梯度(AG)以及结构相似度(SSIM)进行衡量,分别表示如下:

IE表示图像信息量的大小,IE越大表明质量越好[15]

式中,P(xi,j)为像素点xi,j在(i,j)处出现的概率.

MI反应2个图像的信息共享量,MI越大,融合效果越佳, MI表示为[16]

hx,y为x,y的直方图;hx和hy分别为x,y的边缘直方图;L为灰度级.

AG主要表示融合图像中的细节,AG越大,表示图像越清晰[17]

ΔIx(i,j)与ΔIy(i,j)为图像x,y的差分值.

SSIM是反应图像亮度、对比度与结构的因子,SSIM越大,图像越好[18],

μx,μy表示平均亮度;σx,σy和σxy表示标准差.

-

CT的空间辨识能力较强,对骨骼与金属成像清晰;MRI对软组织成像清晰. 图 4为脑部CT与MRI的融合结果,图 4(a),4(b)为CT和MRI图像;4(c)为基于WT的结果,4(d)为基于Contourlet的结果,4(e)为基于PCNN方法的结果,4(f)为本文方法的结果.从图 4可以看出,图 4(c)中的软组织较模糊,对比度较低,没有很好地结合源MRI图像中的互补信息. 图 4(d)中得到的新图像出现了失真,并且在一些局部区域有伪Gibbs现象,降低了融合图像的质量. 图 4(e)中出现了伪影,对比度不理想. 图 4(f)为本文方法获得的实验结果,其很好地保持了CT的骨骼信息与MRI的软组织信息,图像清楚,细节丰富,视觉效果优异,如图中矩形框所示.主要原因是本文根据峰值皮层模型的邻域神经元产生的多特征来完成权重计算,而不是单个神经元的脉冲输出特征.邻域神经元产生的脉冲输出的多特征包括可以表征源图像的灰度信息.利用脉冲图像生成点火映射图像,构建了SCM脉冲输出点火数的融合准则.结合SCM脉冲输出的信息熵与点火映射图像的Weber局部描述WLD,根据信息熵与WLD的相似性计算融合权重.通过WLD与信息熵相结合得到的权重能够获取更优的局部细节.而基于WT方法只能获取水平、垂直、对角线3种的子带,其获取的方向信息不足,软组织被弱化.基于Contourlet变换采用了下采样分解,无平移不变性,易出现伪Gibbs问题,影响了纹理细节.基于PCNN方法存在多变量、融合准则等设定问题,不易得到最优的融合效果,细节还需进一步加强.

图 5为MRI与PET的融合结果,PET具有清晰表示生物分子代谢、神经介质等优势. 图 5(a)、5(b)为MRI、PET图像;5(c)为基于WT的结果,5(d)为基于Contourlet的结果,5(e)为基于PCNN方法的结果,5(f)为本文方法的结果.从图 5可知,图 5(c)的对比度较低,模糊不清,无法清晰表示源图像的信息. 图 5(d)在一些局部区域有伪Gibbs现象,出现了斑点,边缘模糊. 图 5(e)出现了伪影,对于一些细节表示不明显. 图 5(f)为本文方法获得的实验结果,其很好地保持了MRI的软组织信息与PET的分子活动,得到的融合图像清晰,细节较丰富,见图中矩形框.

为了准确反映融合图像的质量,通过给出的4种评价标准对图 4、图 5中的图像进行测量,同时,为了衡量算法效率,对算法运行时间进行统计,所得数据见表 1与表 2.依据表 1、表 2可知,对于这2种不同类型的图像融合效果,相对于其他对照组,本文算法在IE,MI,AG,SSIM上均取得一定的提高,与图 4、图 5得到的客观评价相印证,表明了本文方法融合性优良.另外,根据表 1、表 2可知,对于2组融合实验,本文方法的运行时间分别为5.63 s,5.69 s,均低于其他算法,其运行效率更高.

3.1. 性能评价指标

3.2. 不同类型的图像融合实验

-

本文设计了一种新的峰值皮层模型耦合WLD的MIF算法.首先,引入峰值皮层模型分别计算2幅待融合图像的信息熵、WLD以及点火映射;随后,利用峰值皮层模型的邻域神经元产生的多特征来计算融合权重,最大程度地保留了源图像的灰度信息;然后,根据点火映射图像,建立了点火次数的融合准则.并联合权重系数与融合准则,对2个不同的图像实施融合;最后,通过对CT与MRI图像,以及MRI与PET图像进行融合测试,显示输出的融合图像细节丰富、边缘清晰,保持了源图像的有效信息,从而验证本文提出的方法具有优异的融合性能.

由于本文方法中只是针对像素点融合,忽略了像素与其邻域的联系,接下来需进一步研究,以大幅提高融合的质量.

DownLoad:

DownLoad: