-

开放科学(资源服务)标识码(OSID):

-

红外测温技术在工厂化养殖畜禽健康监测领域具有重要的应用价值,能够实现非接触、快速、大范围的体温检测,有助于畜禽烈性病早期发现与预警。然而,鸡只的红外测温易受羽毛覆盖、环境温湿度以及测量距离等因素影响,导致测温精度下降,难以满足精准健康管理的需求。传统的单点红外测温方法难以克服上述干扰,同时基于单一红外图像的测温技术也因噪声、遮挡等因素造成较大的测量误差。因此,如何提高鸡只红外测温的准确性成为当前工厂化笼养鸡智能化管理中的挑战之一。

近年来,多模态数据融合技术为红外测温校准提供了新的思路。可见光图像能够提供丰富的外观结构信息,红外热图像则反映目标物体的温度分布。可见,二者的结合可以弥补单一传感器的局限性。张在芹[1]在测量猪体温时,在识别猪耳根区域的基础上,通过融合红外相机采集的耳根区域红外图像,以平均值作为猪的体温,智能无接触测量种猪体表温度值。Xie等[2]利用红外热成像仪测量猪体表 6个区域的温度,得到不同区域与肛门温度的关系,通过YOLOv5s-BiFPN模型自动检测图像中猪头的特征部位,通过图像融合提取红外图像中ROI区域的温度。赵一名等[3]结合深度学习和图像处理提出了笼养死鸡检测方法,将红外图像与彩色图像进行图像融合,应用改进的YOLOv5s网络对图像中死鸡进行检测,能够有效检测出笼中的死鸡。姜来等[4]利用红外热成像仪采集鸡只红外图像,通过YOLOv5s深度学习模型对鸡只头部进行识别检测,并采用回归模型建立鸡只ROI区域温度与翅下温度之间的预测模型,实现了肉鸡的自动体温检测。以上研究通过多模态数据融合有效提高了畜禽体温监测的准确性,然而在工厂化笼养条件下,鸡只的羽毛、运动状态以及复杂的环境因素使得传统的图像配准和温度测量方法难以直接适用,亟需构建一种更加鲁棒、自适应的鸡只体温智能监测方案。

红外相机通过测量其所接收的红外线强度从而确定被测物体的温度,所得到的测温结果受到多种因素的影响:①随着测量距离的增加,热红外线发生衰减,红外相机所接收到的红外辐射量降低,导致测量温度变低[5-6];②环境温度变化会使物体温度改变,尽管鸡为恒温动物,但其体表温度也会受到室温的影响,在室温过低的环境中,鸡只体表温度会降低,在室温过高的环境中,鸡只体表温度会升高,从而导致测量结果与正常体表温度之间存在差异[7]。为保证特征部位温度测量的准确性,在测温过程中,需要考虑这2点影响因素,对红外相机所得到的温度进行校准。综上,现有研究中存在的主要问题是:①现有的图像配准和温度测量方法难以直接适用于工厂化笼养模式下的鸡只;②红外相机测温存在温度测量误差。

根据现存不足,本研究提出一种基于图像融合的鸡只红外测温校准方法,通过结合红外热成像、深度图像与可见光视觉信息,构建高精度的温度测量模型。利用多传感器同步采集系统获取鸡只的红外、深度与可见光图像。结合红外温度数据和可见光图像的纹理特征,对鸡只的关键测温区域(如鸡冠、眼周等)进行增强,采用改进的SUFR算法和仿射变换实现双模态图像的精确配准,确保温度数据与视觉信息的空间一致性。利用测量距离和环境温度建立动态温度补偿模型,以修正测量因素带来的测量偏差,从而实现对鸡只特征部位体温进行精准检测。

全文HTML

-

通过红外相机(TIS75+9HZ/CN,福禄克,美国)对鸡只进行拍摄时,同时采集红外图像与RGB图像,用于后期进行图像配准融合训练。采集红外图像307幅,分辨率为384×288。RGB图像数据通过工业相机(SHL-201,顺华利,中国)与智能手机(IQOO 12,VIVO,中国)进行采集,将工业相机的分辨率调整为640×480,帧率为30 fps;将智能手机的分辨率调整为1 920×1 080,帧率为30 fps。在不同时间多次进行视频录制,最终筛选出拍摄的鸡只头部视频数据一共25 min。为丰富数据集中鸡只的状态,对不同状态下的鸡只拍摄照片。为提取出较多的图像用于模型训练,通过OpenCV图像处理库,从所拍摄的视频中每间隔25帧截取1幅图像。从截取的图像中去除模糊和相似的图像,挑选出2 370幅图像,加上拍摄图像526幅,一共2 896幅图像。

-

RGB图像、红外图像和深度图像分别反映了所拍摄鸡只不同的物理信息。RGB图像包含鸡只外观、体态等视觉信息;红外图像包含鸡只体表温度信息;深度图像显示了鸡只与拍摄设备之间的距离信息。

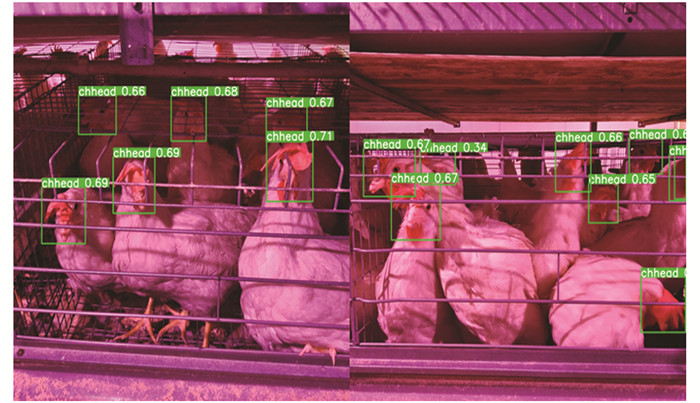

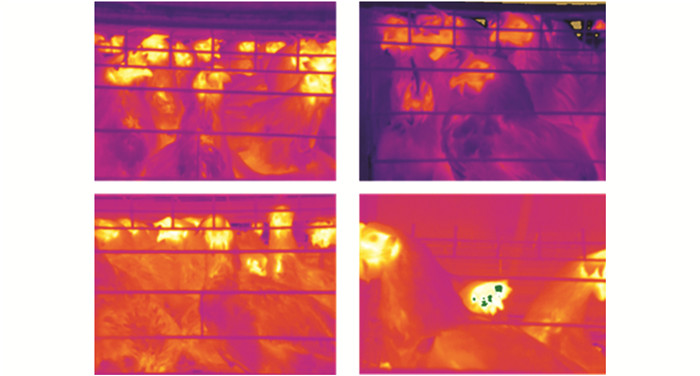

红外相机所拍摄的图像色彩不够稳定,在同一时间段拍摄的图像会出现图像色彩范围变化的情况。一方面是环境温度的变化会影响红外图像的整体色彩,导致图像中不同区域的色彩差异[8]。另一方面是红外相机本身的仪器噪声[9]、仪器增益和偏置漂移[10],导致图像色彩随时间发生变化和图像色彩的波动。图 1所示的图像于同一时间段拍摄,由于拍摄背景温度和图中最低温度不同的原因,导致颜色分布出现差异,在不同图像中鸡只羽毛、头部等的颜色都不相同,并且在红外图像中,鸡头特征部位的颜色信息和外观信息缺失严重,不利于模型对鸡只特征的检测。

为提高鸡头部位的识别准确率,本研究选择RGB图像作为基准图像,识别模型只需检测RGB图像中鸡头的位置。为得到鸡头部位的温度和距离信息,通过图像融合的方法,将RGB图像、深度图像、红外图像进行图像融合,即将3幅图像的像素点重合[11],完成鸡头部位的位置信息、距离信息、温度信息的获取,从而对鸡头的温度进行判断。

拍摄设备的分辨率、视场角、拍摄位置不同,会导致红外图像、RGB图像、深度图像三者所拍摄的画面容纳内容不同。如果直接将3幅图像进行重叠融合,同一特征在融合后的画面中的位置会有偏差,难以达到工作要求。为将RGB图像、红外图像与深度图像三者所显示的画面位置对齐,需将3幅图像进行配准和融合。图像配准[12]是将2幅或多幅图像对齐到同一个坐标系下的过程,以便进行融合或其他处理。图像融合[13]是指在图像配准的基础上,将配准后的图像进行融合,以获得1幅融合图像。融合图像包含了来自不同图像的信息,可以提供更完整、更准确的场景表示。

-

本研究需要匹配的图像是RGB图像和红外图像,通过特征点监测,找到图像中具有显著特征的点,这些特征点可以是角点、边缘点或其他具有独特性质的点。目前图像特征点匹配的算法包括SURF[14]、SIFT[15]和ORB[16]算法。SIFT算法虽然精度较高,但由于计算复杂度较大,难以满足实时性需求;而ORB算法虽然在速度上有优势,但其匹配精度又无法达到工作要求。相比之下,SURF算法兼具计算效率和匹配精度的优势,其快速的特征提取与匹配特性适合移动作业平台的部署需求。综上,本研究选择SURF算法作为特征点匹配算法,以满足后续系统部署对实时性和准确性的双重要求。

SURF算法使用Hessian矩阵的近似值来检测特征点,通过检测Hessian矩阵行列式值大于一定阈值的局部极值点来检测特征点,这些极值点代表了图像中具有显著变化的区域,并通过积分图像和盒形滤波器快速计算。为了使特征描述子具有旋转不变性,SURF算法通过计算Haar小波响应来确定特征点的方向性。Haar小波响应用于描述特征点周围的局部梯度信息,并生成一个方向不变的描述符。使用Haar小波响应生成64维或128维的特征描述符,这些描述符能够有效地表示特征点的局部图像结构。通过最近邻法(FLANN)进行特征匹配[17],以识别图像之间的相似性。FLANN的参数设置为algorithm=1:用KD-Tree算法(适合SIFT/SURF);trees=5:构建5棵KD-Tree,提高查找精度;checks=50:每次搜索检查50个节点,平衡速度和精度。

-

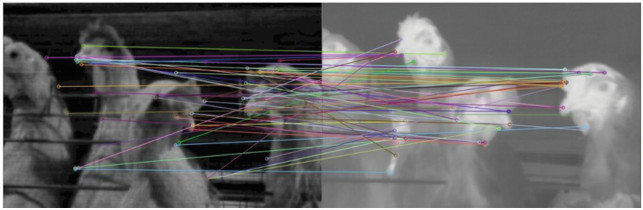

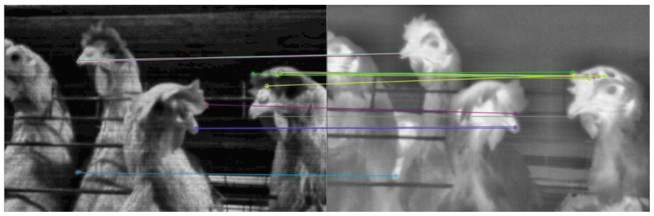

使用SURF算法进行特征点匹配的图像结果如图 2所示,从图中可以看出,所生成的匹配点准确性不高,并且匹配结果中的错误匹配结果较多,不利于后续进行图像融合。为了提高匹配精度,需要对匹配结果进行筛选。使用异常点剔除方法,对所提取的特征点进行初步判断。考虑到图像中的异常点较多,包括过于倾斜的特征点连线、过短和过长的特征点连线,本研究通过特征点连线的斜率和连线长度剔除异常的数据。将斜率阈值设置为0.87,大约是角度为5°的斜率,仅保留小于此斜率数值的连接线,从而剔除异常斜线;将长度阈值设置为图像长度的0.8~1.1倍,剔除过长和过短的连接线。使用了异常点剔除方法的匹配结果如图 3所示,剔除了较多的错误匹配结果,留下匹配准确率较高的点进行后续的融合。

图像配准完成后需进行图像融合,通过特征点计算出图像间的单应性矩阵,完成配准。单应性矩阵是一个3×3的矩阵,描述了2个平面之间的仿射变换关系,它可以将一个平面上的点映射到另一个平面上。例如2幅图像拍摄自同一个平面场景或者2幅图像之间存在纯旋转和平移运动,则两者之间的关系可以用单应性矩阵进行描述。本研究使用RANSAC(Random Sample Consensus)算法[18]进行单应性矩阵估计,以处理错误匹配的特征点。具体步骤为:①从数据集中随机选择最小样本集,使用随机选择的样本拟合模型;②计算剩余数据点与模型之间的残差,若残差小于给定阈值,则该点被认为是内点;③对上述过程进行多次迭代,每次迭代更新模型参数,并统计内点数量,最终选择内点数量最多的模型作为最优模型。

然而,将异常点剔除后仅剩下8对特征点,特征点较少不利于图像融合,因此出现如图 4所示的情况,即融合后的图像中鸡只头部并未完全重合。

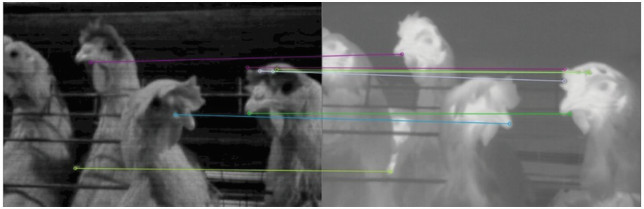

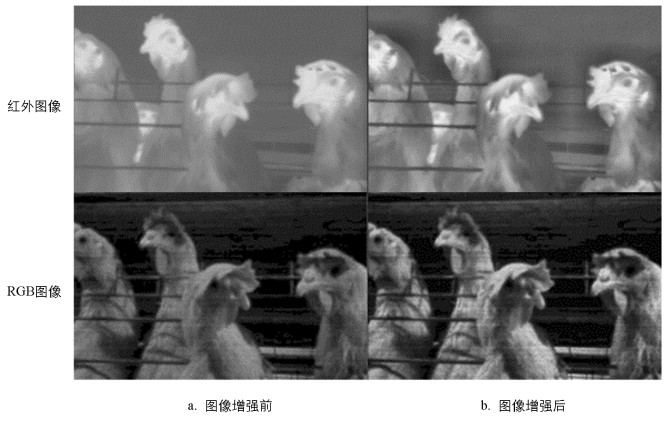

为提高图像融合的精度,在SURF进行特征点提取之前,本研究对所读取的灰度化原始图像进行图像增强处理[9]。采用OpenCV图像处理库自带的createCLAHE函数进行直方图均衡化来提高对比度,对比度限制阈值(ClipLimit)设置为2,局部均衡化(TileGridSize)设置为(8,8)。

从图 5中能够看出,提升对比度后图中的色彩区分更明显,特征更突出。对增强后的图像进行特征点提取,如图 6所示,图像增强后,最后所剩余的特征点数目达到了13对,相较于图 3中的8对有明显的提升。通过所得到的特征点进行图像融合,如图 7所示,相较于图 4呈现的效果,鸡头对齐的准确度得到提升。

通过熵对图像融合效果进行评判,融合后图像的熵越大,通常说明融合效果越好,其包含了更多原始图像的信息[3]。对增强前后图像的熵进行对比,如表 1所示。能够看出通过图像增强后,熵值得到明显的提升。

-

在以往研究中,通过目标检测算法,已完成RGB图像中的鸡头位置识别[19],能够准确识别出鸡头在RGB图像中的检测框,如图 8所示。

在温度提取过程中,利用红外相机获取鸡只头部的温度信息。通过深度相机获取鸡只和红外相机之间的距离信息,从而添加鸡头与红外相机之间的距离信息,对红外相机所获得的温度进行校准。通过1.2节中的图像对齐融合,3幅图像的像素点位置已重合。将RGB图像中得到的检测框坐标,对应在红外和深度图像中,从而得到鸡头的温度信息和距离信息。层叠笼之间采用铁丝网进行隔断,因此相机在拍摄过程中,相邻笼中的鸡只均会出现在画面中,导致模型检测出的鸡头包含有其他笼中的鸡只。为保证所检测的鸡只都在当前检测笼中,通过深度相机提取被检测出的每个鸡头的距离信息,并根据养殖笼的深度(80 cm),设置距离阈值为85 cm,即多设置5 cm作为距离误差,则只需检测距离范围内的鸡只,就可将相邻笼中的鸡只从所检测的图像中剔除。

由于采用矩形检测框,映射坐标信息在红外图像与深度图像中,检测框中就会包含铁框的温度与其他养殖笼中鸡只的温度,因此需要将检测框区域中的温度进行过滤。首先通过距离阈值,将检测框中大于距离阈值的坐标点剔除,再建立温度阈值对检测框中的异常温度进行剔除。

通过福禄克公司的SmartView软件对所采集的红外图像进行分析,如图 9所示。所采集的图像中,鸡只头部区域最高温度为40.1 ℃,平均温度在34.6 ℃左右。由于头部部分位置依然存在羽毛覆盖的情况,因此头部最低温度在32.2 ℃左右。为完整地剔除低温部位,以33 ℃作为温度阈值,将检测框中低于33 ℃的温度去除,包括羽毛覆盖严重的部位、养殖笼铁丝遮挡物和环境温度,仅保留高温部位。

红外相机所拍摄的温度会出现一定的温度漂移[20-21],若只采用最高温度作为评判标准,所得到的温度可能出现误差,并造成误判。鸡只作为恒温动物,同一部位体温也相对均衡,以鸡头平均温度作为鸡只头部温度,所得到的数据也更加平稳,同时能够减轻红外相机温度漂移所带来的影响。鸡只头部平均温度的公式为:

式中:P为鸡只头部平均温度;T为去除干扰温度后像素点的总温度;N为去除干扰温度后剩下像素点的数量。

1.1. 数据采集

1.2. 图像融合

1.2.1. 图像配准算法选择

1.2.2. SURF算法优化

1.3. 温度提取方法

-

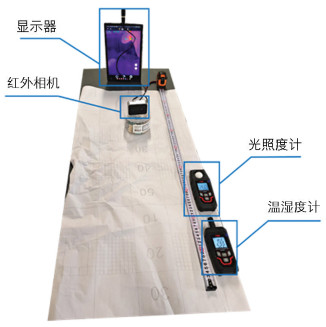

为探究不同影响因素与红外相机温度测量的相关性,进行测温实验,如图 10所示。选用卷尺对测量距离进行控制,利用光照度计测量环境光照强度,通过温湿度计测量环境温度和湿度。本研究在实验过程中所使用的图像采集设备参数如下:红外热成像机芯Hikvision TB-4117-3/s的分辨率为120×160,测温范围为30~45 ℃,测温精度为±0.5 ℃,视场角为37.2°×50°,测温距离为0.3~2 m。深度相机LeShi AstraPro的彩色图像分辨率为1 280×720@30 fps、640×480@30 fps、320×140@30 fps,视场角为66.1°×40.2°;深度图像分辨率为1 280×720@30 fps、640×480@30 fps、320×140@30 fps,视场角为58.4°×45.5°,精度为±1~3 cm@1 m。

-

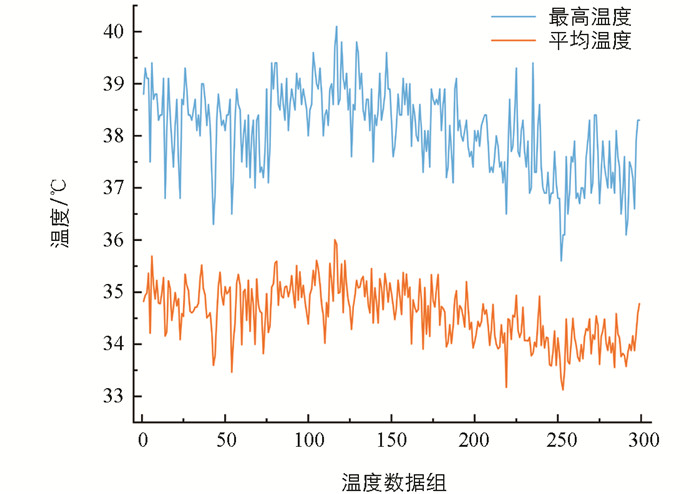

养殖笼宽度为40 cm,鸡只在养殖笼中的位置不是固定的,因此,同一个笼中鸡只距离红外相机的位置都不同,导致测温存在差异。在室温23 ℃和湿度50%RH的条件下进行实验,通过调整红外相机与被测物之间的距离,得到红外相机所测温度与测量距离的衰减关系。以人手作为测温物体进行温度测量,因为人手的皮肤与鸡头部位皮肤质感相似,能够减小表面反射率的影响。设置红外相机的发射率为0.95,距离设置范围为5~110 cm,间隔5 cm或10 cm设置测温点,在每个距离点下测量6次温度,求出所测量温度随测量距离的衰减值,如表 2所示。通过温度数据得到温度随测量距离的衰减曲线,如图 11所示。

通过三次函数对测量数据进行拟合,得到本实验所用的红外相机测温度与到测物距离之间的温度补偿关系式:

其中:B为补偿温度;D为测量距离;Y为补偿后的温度;H为红外相机得到的温度信息。

从图 11可以看出,在测量距离为40~80 cm范围内,温度衰减值变化较小,表明所测量的温度衰减值相对稳定,因此在实际测温工作中,设置温度采集设备距离养殖笼40 cm。由于养殖笼宽度同样为40 cm,因此所测量的鸡只都在距离红外相机40~80 cm范围内,有利于保证测温的稳定性和准确性。

-

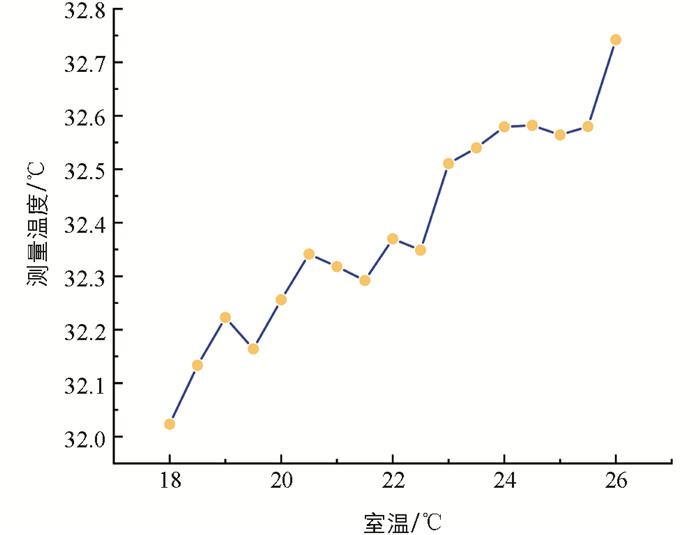

不同生长期的鸡只,生长所需的环境温度不同(0~3周雏鸡:32~35 ℃;4~8周生长鸡:24~27 ℃;9~16周育成鸡:18~21 ℃;产蛋鸡:18~25 ℃)。为适应不同生长期和不同养殖目的的养殖环境,设置不同的养殖温度实验条件。为控制变量,保证实验湿度为50%RH,在环境温度为17~27 ℃范围内进行测温(不适用于雏鸡,因此不选择雏鸡的温度范围)。在封闭环境内,通过空调对室温进行调控。根据温度随测量距离的衰减值,选择温度平稳区间的距离。根据图 11的测量结果,设置测量距离为60 cm,在每个室温点下测量15次温度,并求出平均值,如图 12所示。

从图 12可以看出,随着室温的上升,体表温度也存在一定的上升趋势。对每个室温点的平均温度进行分析,所测量温度的平均值存在一定的波动,但整体呈现上升趋势。在全温度范围内,所测量温度仅上升约1 ℃。鸡只的养殖室温相对固定,仅存在1~2 ℃的变化,并且不同养殖环境下鸡只长时间生存,其体表温度会适应环境。若将室温对测温的影响考虑进所有的测量场景,则对温度测量的准确性会造成影响。为保证测温的准确性,当设备应用于不同的养殖场景时,调整测温阈值即可对养殖厂鸡只体表温度进行评估。

-

对设备调试完成后,在重庆市荣昌区铜鼓山产蛋基地第1栏鸡笼中进行温度检测测试,实验日期为2024年4月20日,实验场景如图 13所示。为了保证检测的可靠性,检测平台在每个鸡笼处暂停4 s,在此期间设备进行6次检测,以保证笼中鸡只都出现在画面中,能够有效降低鸡只在运动过程中由于鸡头被完全遮挡产生的漏检情况。

在实际检测过程中,设置最高温度阈值和平均温度阈值对鸡只体温状况进行评判。根据1.3节中的鸡只温度分析并结合2.1节中红外测温随测量距离的衰减值,设置最高温度阈值为41 ℃,平均温度阈值为38 ℃,若测量结果超过温度阈值则将此笼鸡只判断为问题鸡只。

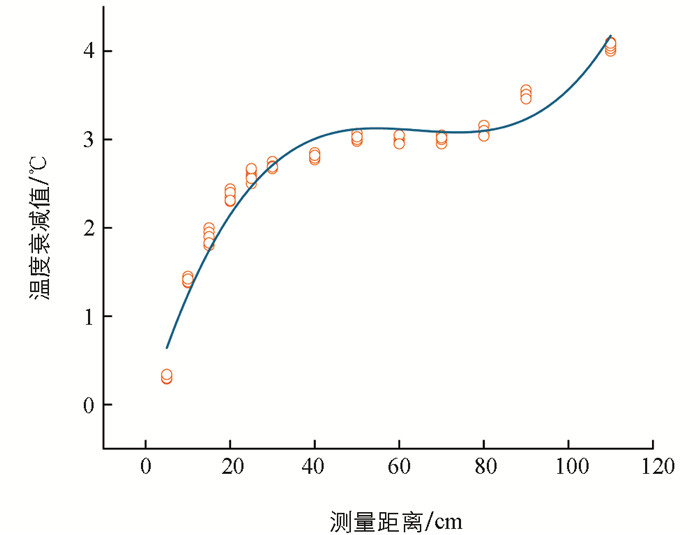

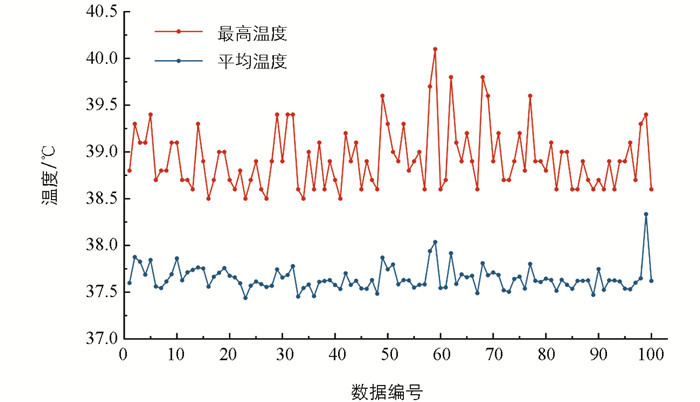

实验过程中,该设备自动记录所检测鸡头的平均温度和最高温度,并保存在后台中。同时在检测到异常体温鸡只时,向养殖场工作人员发出警报信号。在养殖场室温为23 ℃的条件下进行实验,通过设备获取了100组温度数据,如图 14所示。由于所设置的温度阈值低于鸡只的正常体温,因此得到的平均温度会低于鸡只的正常体温。实验结果显示,所采集鸡只的最高温度为40.18 ℃,平均温度为37.75 ℃,可能是因为鸡只个体差异和红外相机温度漂移造成的温度波动。

为验证本研究设备温度测量的准确性,随机选取了其中10个养殖笼,利用手持式热成像仪测量了20只鸡的头部温度,测量距离保持在10 cm以内,以消除红外温度衰减带来的误差。同时通过本研究的体温测量设备按照实验过程中的相同条件进行温度采集。对每只鸡的体温进行多次测量取温度平均值。以手持式热成像仪所测量的温度作为标准值,对所测量的最高温度进行分析,得到鸡头温度检测的相对误差结果,如表 3所示。其中相对误差的最小值为0.08%,最大值为1.70%,能够满足鸡只的体温测量任务。

2.1. 距离信息校准

2.2. 温度信息校准

2.3. 鸡只温度测量实验

-

本研究针对工厂化笼养条件下鸡只红外测温易受检测距离干扰的问题,提出了一种基于多模态图像融合的温度校准方法,结合红外热成像、深度图像与可见光视觉信息,构建了高精度的温度测量模型。通过改进的SURF算法和仿射变换实现多源图像的精确配准,并利用深度学习模型识别鸡只头部测温区域,建立了动态温度补偿模型,有效排除了背景干扰。该方法在40~80 cm的测量距离范围内表现稳定,温度衰减波动较小,相较于传统单点红外测温技术,该方法通过多模态数据融合和动态补偿机制,显著提高了鸡只体温检测的鲁棒性和适应性,为畜禽智能化养殖中的健康监测提供了可靠的技术支持。

然而,本研究仍然存在一定的局限性:红外相机硬件产生的温度漂移,对温度采集可能造成一定的影响,会导致所测量的温度不够稳定。未来研究中采用精度更高和测温更加稳定的红外相机,并提出相关算法,以减轻温度漂移对测温的影响。同时,还可提升检测的跨物种泛化能力:该方法主要针对笼养鸡设计,但其核心框架(多模态融合+动态补偿)可拓展至猪、牛等其他畜禽的体温监测。后续研究可收集不同物种的数据,验证方法的通用性,并针对不同动物的生理特征优化温度补偿模型。

综上所述,本研究为畜禽智能化健康监测提供了可行的技术方案,未来可通过算法优化、硬件升级和大规模场景验证,进一步提升系统的实用性,推动精准畜牧业的发展。

下载:

下载: